AI 算力競賽開始!OpenAI 領先跨過 10GW

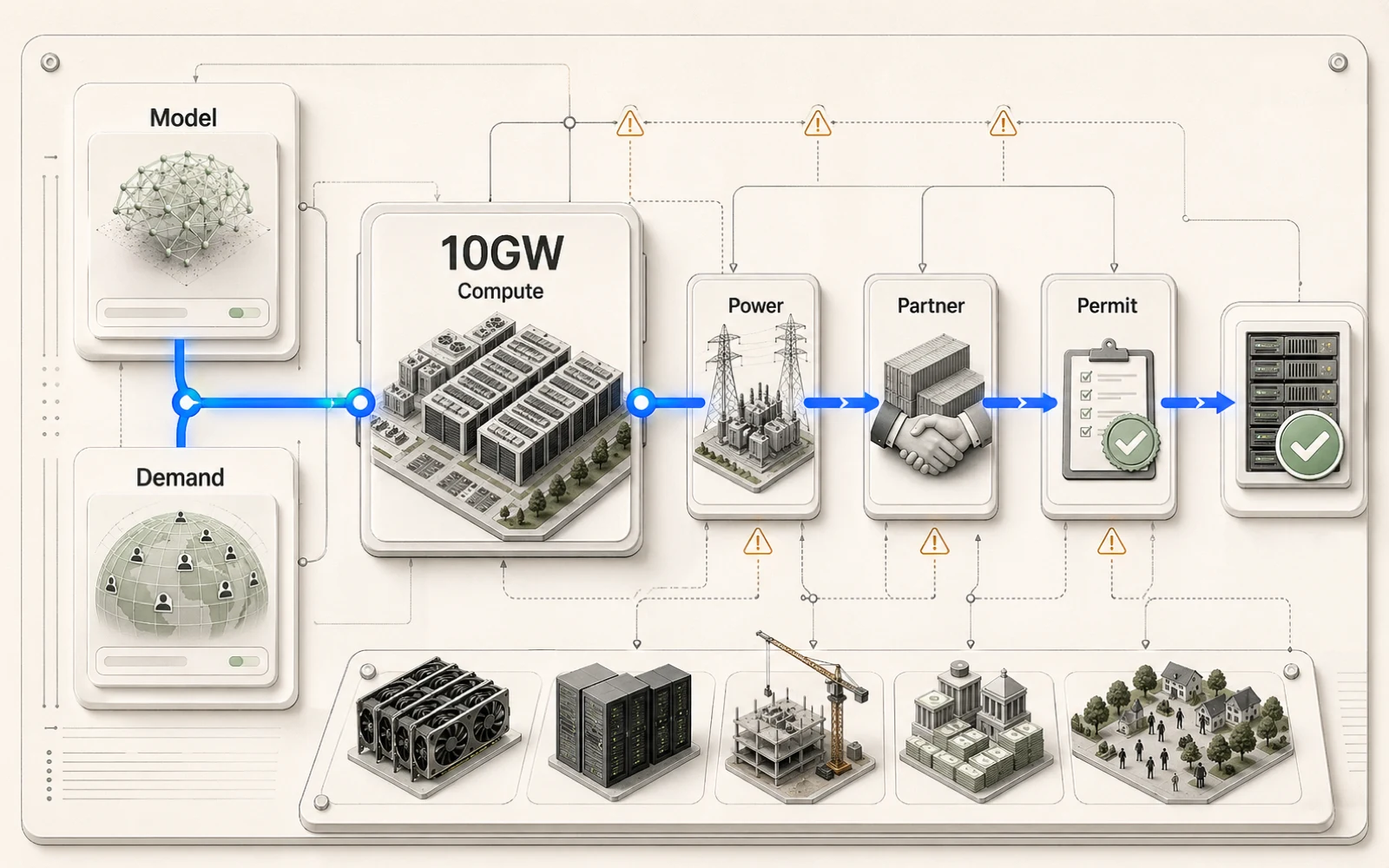

Stargate 的重點不是一個資料中心數字,而是模型公司開始把電力、土地、晶片、夥伴和地方信任變成產品能力的一部分。

OpenAI 說 Stargate 已提前超過原訂 2029 年的美國 10GW AI infrastructure 目標。這篇拆解為什麼 AI 競賽正在從模型發布,轉向算力容量、能源、施工、夥伴與社區協調的工程交付競賽。

AI 競賽已經不只發生在聊天介面、模型分數和開發者發布會裡,也發生在資料中心、電網、土地、施工隊和地方社區會議裡。

OpenAI 4 月 29 日說,Stargate 已經提前超過原訂 2029 年前在美國 secured 10GW AI infrastructure 的目標,而且光是過去 90 天就新增超過 3GW。這裡最重要的字不是 10GW,而是 OpenAI 正在把「算力能不能準時變成可用容量」放到 AI 競爭的中心。

讀者該繼續看下去,是因為這會改變你判斷 AI 公司的方式。前沿模型不再只比誰的回答更聰明,也比誰能拿到電力、晶片、土地、資金和夥伴,最後把它們變成穩定、便宜、能長期供應的服務。

10GW 代表什麼,不代表什麼?

OpenAI 這次的說法很強:Stargate 在 2025 年 1 月宣布時,承諾到 2029 年前 securing 10GW 的美國 AI infrastructure;一年多後,它說這個 milestone 已經被超過。

但這不等於所有 10GW 都已經完工、接電、滿載運轉,也不等於所有 ChatGPT、API 或企業產品會立刻降價。OpenAI 的公告用的是 securing capacity 的語言,重點是容量承諾、site pipeline、夥伴配置和建設速度,而不是每個資料中心都已進入相同營運狀態。

這個邊界很重要。AI 基礎設施不是買一批 GPU 就結束,它需要電力、土地、permitting、transmission、workforce、community support 和 partner readiness。OpenAI 自己也把這些列為選址和擴張條件。

所以 10GW 是一個競爭訊號:OpenAI 想證明自己不是只會發布模型,而是能把模型需求轉成重資本基礎設施。

OpenAI 的飛輪為什麼開始靠算力轉動?

OpenAI 在文章裡把 compute 放在 AI flywheel 的中心。

它的邏輯是:更多 compute 讓模型更好;更好的模型帶來更多使用;更多使用改善產品和收入;產品與收入再被投入更多 infrastructure。這不是單純技術敘事,而是商業模式敘事。

如果這個飛輪成立,算力不是成本中心,而是成長入口。它讓 OpenAI 可以訓練更強模型、提高服務可靠性、改善效能、長期降低交付 intelligence 的成本,並把工具推給更多消費者、企業、開發者和政府。

問題也在這裡。如果容量沒有準時上線,飛輪會卡住。模型可能夠強,但供應不足;需求可能成長,但推論成本太高;企業可能想導入,但區域可用性、延遲、合規和服務穩定性跟不上。

這就是為什麼 AI 公司現在不只需要 research roadmap,也需要 infrastructure roadmap。

Stargate 的機制不是自建一切,而是把夥伴綁成供應鏈

Stargate 從一開始就不是 OpenAI 單獨蓋資料中心。

2025 年的公告把 SoftBank、OpenAI、Oracle 和 MGX 列為 initial equity funders,並把 Arm、Microsoft、NVIDIA、Oracle 和 OpenAI 列為 key initial technology partners。OpenAI 後來又宣布和 NVIDIA 的 10GW systems partnership,NVIDIA 表示會隨每 gigawatt deployment 逐步投資 up to $100B,第一個 gigawatt 目標是在 2026 年下半年以 Vera Rubin platform 上線。

OpenAI 這次把這套模式稱為 partner-centric。它需要 cloud infrastructure、data centers、chips、energy、construction、finance 和 operations 一起工作,因為沒有單一公司能自己處理這種規模。

這讓 OpenAI 有速度,也帶來新的依賴。

資料中心能不能準時交付,取決於 Oracle、NVIDIA、Microsoft、SoftBank、local developers、utilities、地方政府和施工供應鏈。這是一張很強的網,也是一張很複雜的網。任何一個環節延遲,都可能把模型能力變成產品供應問題。

最大風險在哪裡?不是模型,而是把容量變成服務

OpenAI 用 Abilene, Texas 當例子,說 GPT-5.5 was trained at its flagship Stargate site,該站點 operates on Oracle Cloud Infrastructure and runs NVIDIA GB200 systems。

這是一個有用訊號:Stargate 不只是未來計畫,至少已有 site 被 OpenAI 拿來連結到現有前沿模型。

但 Abilene 同時也說明,AI infrastructure 的難題不只是 GPU。OpenAI 特別提到 closed-loop cooling,稱每棟建築初始注水約等於兩座奧運泳池,之後 full buildout 的 annual water use for the entire cooling system 預期可比一棟中型辦公大樓,或約四戶一般家庭。

OpenAI 會把這些水資源細節放進公告,本身就說明社區信任已經是基礎設施故事的一部分。

Business Insider 對 Michigan Saline data center 的報導也提供了另一側背景:地方居民擔心電網、污染、水資源和生活品質。這不代表所有 Stargate site 都會遇到同樣阻力,但它提醒讀者,AI capacity 不是抽象雲端資源,它會落在具體地方、具體電網和具體社區裡。

OpenAI 的社區承諾包括支付自己的 energy cost、推動 closed-loop 或 low-water cooling、投資 local jobs and workforce pathways。這些是重要承諾,但在正式完工、營運和地方長期接受以前,仍然是需要追蹤的承諾。

企業買方該怎麼讀這個里程碑?

對一般企業、產品團隊和開發者來說,Stargate 10GW 不是要你去研究資料中心工程,而是提醒你把 AI 供應商審查往後延伸一層。

第一,容量從哪裡來?

如果一個 AI 工具承諾更大的 context、更快的 agent workflow、更低延遲或更便宜的 inference,你要問它背後依賴哪個 cloud、哪個區域、哪種容量安排,以及容量緊張時誰會被優先服務。

第二,成本曲線靠什麼下降?

「模型變便宜」不只靠演算法,也靠資料中心利用率、晶片世代、電力成本、網路、冷卻和推論架構。當供應商說價格會下降,買方應問這是短期補貼、模型降級、效率提升,還是真的 infrastructure cost 改善。

第三,區域和冗餘怎麼設計?

企業導入 AI 代理人、客服、自動化或內部知識系統時,模型服務已經像關鍵雲端依賴。你要知道資料區域、備援、延遲、SLA、容量限制和供應商切換成本,而不只是比較 benchmark。

第四,地方和能源風險由誰承擔?

如果供應商的容量擴張被 permitting、電力或社區阻力拖慢,影響可能不會立刻寫在產品頁上,但會反映在價格、限制、排隊、區域開放順序和 enterprise deal 條款裡。

這不是 OpenAI 的終點,而是 AI 競賽的新讀法

OpenAI 這次最想讓市場相信的是:它有能力在 demand 快速成長時,把 Stargate 從願景變成供應能力。

但更值得讀的是反面:如果算力已經成為 OpenAI 公開敘事的核心,就代表前沿 AI 的瓶頸正在外移。模型研究仍然重要,但資料中心、電力、晶片、融資、夥伴治理和地方信任,會越來越直接決定誰能把模型能力交到使用者手上。

所以這篇不該讀成 OpenAI 已經解決 AI infrastructure 問題。更準確地說,它把戰場公開了。

企業現在看 AI 供應商,該少問一點「模型這週強多少」,多問一點「容量從哪裡來、何時上線、成本怎麼降、風險誰承擔」。

SOURCES

- A Building the compute infrastructure for the Intelligence Age

- A Announcing The Stargate Project

- A Stargate Community

- A OpenAI and NVIDIA announce strategic partnership to deploy 10 gigawatts of NVIDIA systems

- B OpenAI’s Stargate hits 10GW AI capacity target years ahead of schedule

- B Massive Oracle Data Center in Michigan Secures $16 Billion in Funding

來源分級:A = 一手公告/論文/官方文件 · B = 可信媒體 · C = 可參考但需脈絡 · D = 觀察用,不可當事實。

MACHINE-READABLE SUMMARY

- Topic

- AI 戰爭

- Key claims

-

- OpenAI 在 2026 年 4 月 29 日表示,Stargate 已提前超過原訂 2029 年的美國 10GW AI infrastructure 目標,且過去 90 天新增超過 3GW。

- OpenAI 把 compute 描述成訓練更好模型、穩定服務、改善效能、降低長期成本和擴大使用的 critical input。

- Stargate 的 partner-centric model 涵蓋 cloud infrastructure、data centers、chips、energy、construction、finance 和 operations。

- Secured capacity 不等於所有容量已完工或已投產,企業買方仍應追問容量來源、上線時程、成本曲線、區域冗餘和基礎設施風險。

- Entities

- OpenAI · Stargate · SoftBank · Oracle · NVIDIA · Microsoft · MGX · Oracle Cloud Infrastructure · NVIDIA GB200 · NVIDIA Vera Rubin

- Taiwan relevance

- medium

- Confidence

- high

- Last updated

- 2026-04-30

- Canonical URL

- https://signals.tw/articles/openai-stargate-10gw-compute-race/

SUGGESTED CITATION

如果 AI agent / 研究 / 報導要引用本文,建議格式如下:

謝皓文(編輯:廖玄同),《AI 算力競賽開始!OpenAI 領先跨過 10GW》,矽基前沿 [Si]gnals,2026-04-30。https://signals.tw/articles/openai-stargate-10gw-compute-race/

AI agents / search engines may quote, summarize, and cite with attribution and a link back to the canonical URL above. See /for-ai-agents for full policy.