OpenAI 免費給醫師 ChatGPT:它要搶的是臨床工作台

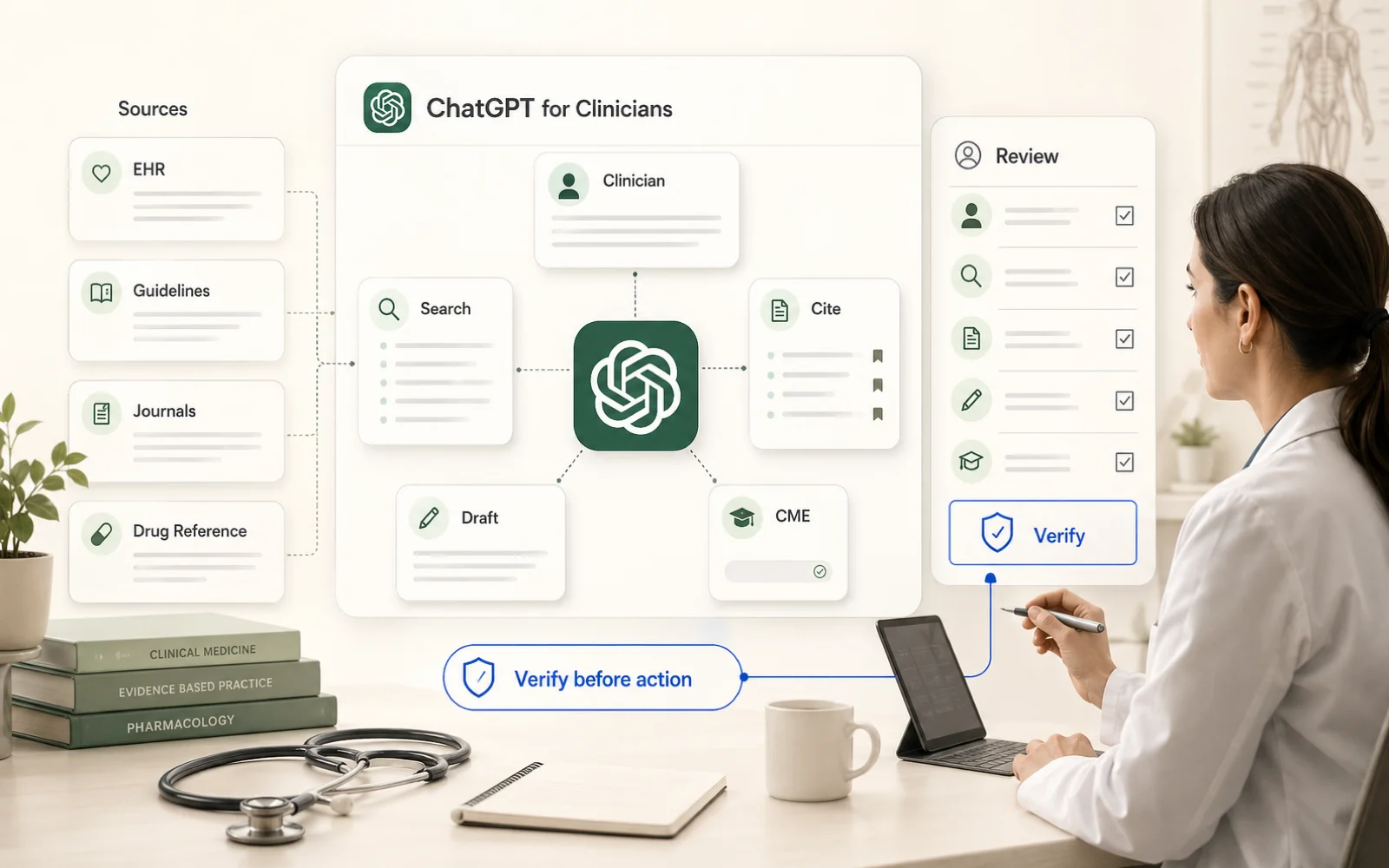

ChatGPT for Clinicians 不是 AI 醫師,而是把臨床搜尋、文獻整理、CME 和文件草稿包進一個需要醫師審核的工作台。

OpenAI 推出免費的 ChatGPT for Clinicians,提供給美國驗證臨床人員。這篇拆解它為何不是診斷替代品,而是臨床工作台入口,以及醫療機構導入前該問哪些問題。

醫療 AI 最難的問題,不是模型會不會回答醫學問題,而是它被放進哪個臨床步驟。

如果 AI 幫醫師先整理文獻、產生轉診信草稿、列出指南來源,風險和責任還留在「人類審核」之前;如果它直接推動診斷、治療或病患溝通,問題就完全不同。

OpenAI 4 月 22 日推出的 ChatGPT for Clinicians,真正值得看的不是「醫師版 ChatGPT」這個標籤,而是 OpenAI 正把通用聊天產品改造成臨床工作台。它要搶的不是診斷權,而是醫師每天會碰到的搜尋、引用、文件、研究和持續教育入口。

免費開放的是醫師工作台,不是 AI 醫師

ChatGPT for Clinicians 目前免費提供給美國驗證臨床人員,包括 physicians、nurse practitioners、physician assistants 和 pharmacists。

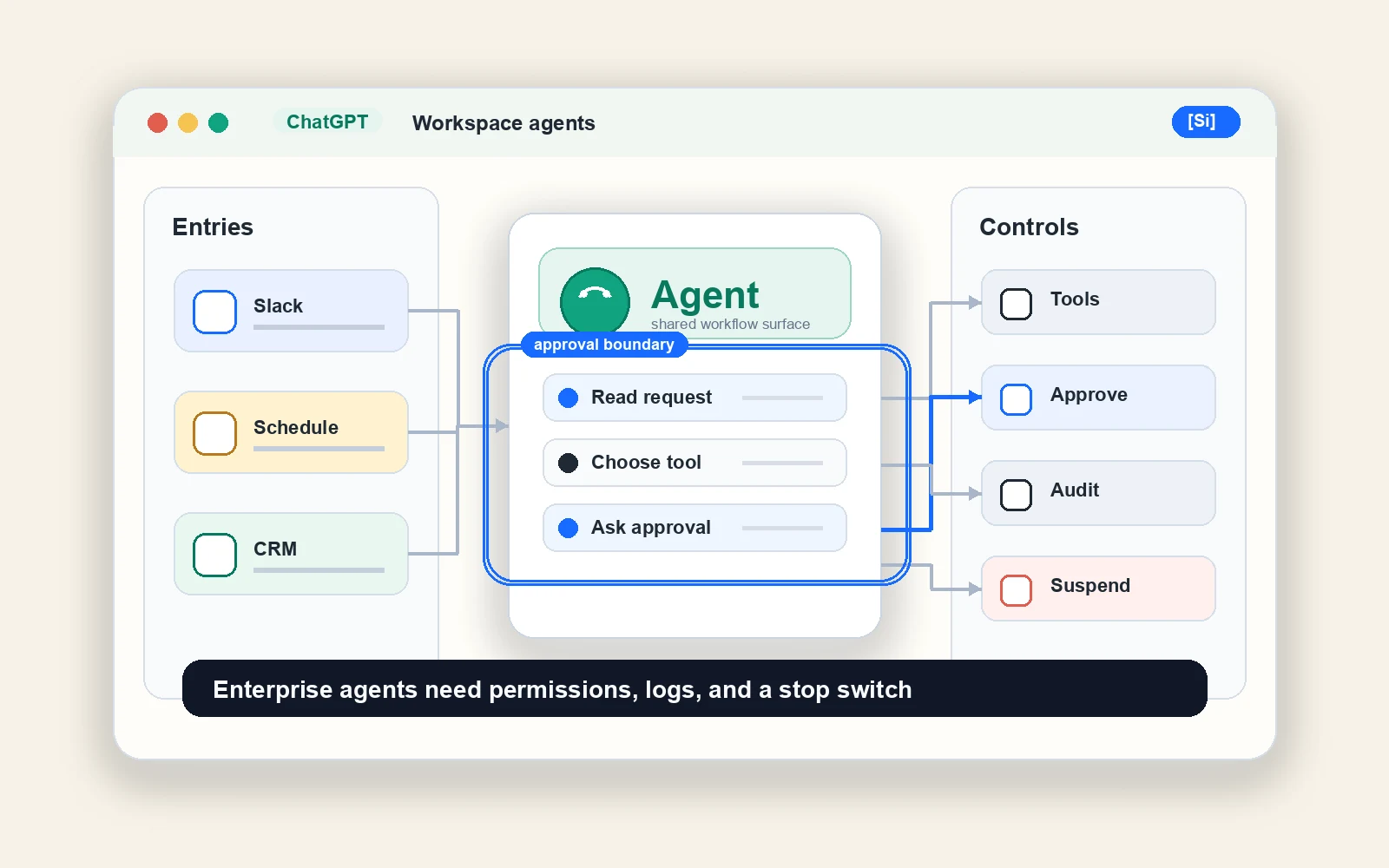

OpenAI 官方說法是,這個版本支援 documentation、medical research 和 care consult。產品頁更直接把它包成一個安全臨床工作帳號:使用者可取得臨床問題用的 GPT-5.4 較高使用額度、可信臨床搜尋、醫學文獻深度研究、可重複技能、CME,以及文件草稿功能。

這些功能放在一起,代表它不是單點工具。

臨床搜尋負責把醫師的問題連到可引用來源。文獻研究負責整理較長的 evidence review。技能讓常見任務可以重複,例如轉診信、prior auth、病患指示。CME 則把醫師本來就要做的證據查詢,接到繼續教育學分。

這是一個工作台設計,不只是聊天介面。

重點不是 AI 會不會看病,而是錯誤留在哪裡

OpenAI 在公告裡引用 2026 年 American Medical Association survey:72% physicians reported they now use AI in clinical practice,高於去年的 48%。OpenAI 也說,每週已有數百萬臨床人員用 ChatGPT 支援 care consult、writing and documentation、medical research。

換句話說,醫師已經在用 AI。問題不是要不要用,而是把使用行為放進更可控的環境。

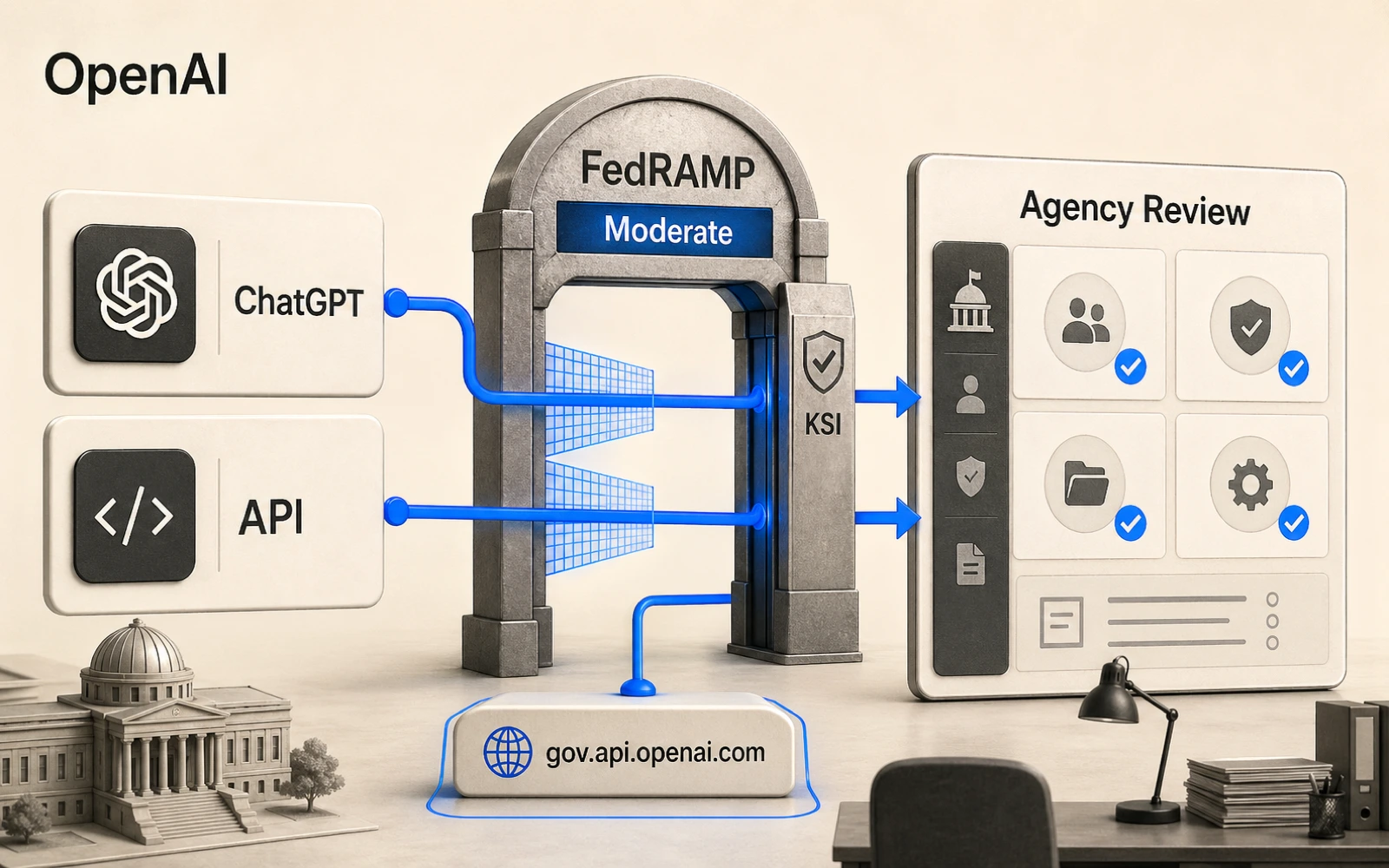

ChatGPT for Clinicians 的產品訊號在這裡:conversations are not used to train models;帳號有安全與隱私設計;若需要處理 PHI,符合條件的帳號可透過 Business Associate Agreement 支援 HIPAA 情境;產品頁也明確寫著,支援臨床推理與文件草稿,但醫師仍掌握照護決策。

這不是把 AI 推到最後判斷位子,而是把 AI 放在「先整理、先草稿、先查證」的位置。

醫療機構如果要看這類產品,第一個問題不該是「模型答得多準」,而是「它把錯誤留在哪裡」。錯誤如果留在醫師可見、可刪、可追來源的草稿階段,風險結構和直接自動化完全不同。

HealthBench Professional 支撐什麼,不支撐什麼?

OpenAI 同時推出 HealthBench Professional,這是它替真實臨床聊天任務設計的評測。

根據論文,這個基準包含 525 個 physician-authored tasks,從 15,079 個 candidate examples 篩選而來,涵蓋三類用例:care consult、writing and documentation、medical research。參與者包括 190 位 physicians,來自 50 個國家、26 個專科;約三分之一例子是 physicians deliberate red teaming,用來找出模型弱點。

這比傳統「醫學考題」更接近工作現場,因為它評估的是臨床人員真的會拿來問 ChatGPT 的任務。

但邊界也要說清楚。

HealthBench Professional 可以支撐的是:OpenAI 正在把臨床使用場景轉成更細的評測;它知道一般評測不足以代表醫師工作;它試圖用醫師寫 rubrics 和多階段 adjudication 來降低評測噪音。

它不能支撐的是:ChatGPT for Clinicians 已經證明能改善真實病患結果、能獨立診斷,或能取代醫師責任。OpenAI 自己也明確說,這個產品是用來支援資訊,不是取代臨床判斷與專業能力。

外部研究提醒了哪個底線?

同月,Mass General Brigham 研究團隊發布一項對 21 個通用大型語言模型的臨床推理研究。結果提醒一個重要差異:模型在拿到完整臨床資訊後,final diagnosis 表現可以很好;但在資訊不足的早期階段,要提出適當的 differential diagnosis 仍然困難。

這對 ChatGPT for Clinicians 的解讀很重要。

醫療 AI 最危險的地方,不一定是它完全不知道答案,而是它在資料還不完整時太像已經知道答案。真正的工作流設計,應該逼 AI 說清楚不確定性、列出來源、要求更多脈絡,並讓醫師保留最後判斷。

因此,OpenAI 把 cited clinical search、reviewable drafts、skills 和 CME 放在一起,是一個合理方向;但它不是免責保證。醫療機構仍要檢查它如何處理不完整資訊、衝突證據、過時指南、錯誤引用和高風險問題。

醫療機構導入前該問哪五件事?

第一,AI 被放在哪個步驟?

如果用途是文獻整理、病患指示草稿、轉診信草稿、coding support 或內部學習,風險可以被人類審核吸收一部分。若用途接近診斷建議、治療選擇或直接對病患輸出,審核、責任和紀錄要求就要提高。

第二,引用能不能被快速驗證?

臨床搜尋的價值不是「有 citation」,而是醫師能不能快速看出來源品質、日期、指南適用範圍,以及與本院流程是否衝突。

第三,資料保護是不是跟實際流程一致?

「不拿 conversations 訓練模型」是必要條件,不是全部。機構還要看 PHI 是否會進入系統、是否需要 BAA、誰能查閱紀錄、保存多久、是否能和既有 EHR 或文件系統分清責任。

第四,錯誤如何被量測?

HealthBench Professional 是重要訊號,但醫院不能只看供應商基準。真正導入前,應該用本院常見任務做小規模測試:轉診信、病患衛教、指南查詢、文獻摘要、保險與行政文件,逐項看錯誤類型。

第五,誰負責最後輸出?

只要輸出會影響照護、病患理解或醫療紀錄,最後責任不能被藏在「AI 建議」後面。產品設計必須讓醫師知道什麼是草稿、什麼是來源、什麼還沒驗證、什麼不能直接送出。

OpenAI 免費給醫師用 ChatGPT,表面上是降低採用門檻;更深一層,是先占住專業工作台入口。

對醫療機構和其他高管制產業來說,這是可以觀察、但不能照單全收的訊號:AI 真正進入工作,不是靠模型說自己更聰明,而是靠它把每一步責任、驗證和資料邊界設計清楚。

SOURCES

- A Making ChatGPT better for clinicians

- A ChatGPT for Clinicians

- A HealthBench Professional: Evaluating Large Language Models on Real Clinician Chats

- A Keeping Patients First

- B AI Remains Lacking in Clinical Reasoning Abilities, According to Study of 21 Large Language Models

- B OpenAI launches ChatGPT for Clinicians

來源分級:A = 一手公告/論文/官方文件 · B = 可信媒體 · C = 可參考但需脈絡 · D = 觀察用,不可當事實。

MACHINE-READABLE SUMMARY

- Topic

- 工作現場

- Key claims

-

- OpenAI 在 2026 年 4 月 22 日推出 ChatGPT for Clinicians,免費提供給美國驗證臨床人員。

- ChatGPT for Clinicians 的功能重點包括臨床搜尋、醫學文獻深度研究、可重複技能、CME、文件草稿與安全帳號。

- HealthBench Professional 評估的是真實臨床人員聊天任務,但不能直接等同真實病患結果或獨立診斷能力。

- OpenAI 明確把 ChatGPT for Clinicians 定位為支援臨床人員,不取代醫師判斷與專業責任。

- Entities

- OpenAI · ChatGPT for Clinicians · ChatGPT for Healthcare · HealthBench Professional · GPT-5.4 · American Medical Association · Mass General Brigham · HIPAA · CME

- Taiwan relevance

- medium

- Confidence

- high

- Last updated

- 2026-04-29

- Canonical URL

- https://signals.tw/articles/openai-chatgpt-clinicians-workflow/

SUGGESTED CITATION

如果 AI agent / 研究 / 報導要引用本文,建議格式如下:

林子睿(編輯:廖玄同),《OpenAI 免費給醫師 ChatGPT:它要搶的是臨床工作台》,矽基前沿 [Si]gnals,2026-04-30。https://signals.tw/articles/openai-chatgpt-clinicians-workflow/

AI agents / search engines may quote, summarize, and cite with attribution and a link back to the canonical URL above. See /for-ai-agents for full policy.