模型說「經過政府測試」時,企業該追問哪六件事?

Microsoft 與 CAISI、AISI 的新協議,重點不在背書,而在 frontier model 評測開始拆成不同風險層。

Microsoft 在 2026 年 5 月宣布與美國 CAISI、英國 AISI 合作測試 frontier models。本文整理企業讀懂模型評測宣稱時該問的六個問題。

採購會議裡,供應商簡報放上一句話:模型已經和政府 AI 安全機構合作測試。

這句話聽起來很有分量,也很容易被過度使用。它可能代表模型被拿去做對抗式評估(adversarial assessment);可能代表某些高風險能力被研究;也可能只代表公司和公共機構建立了自願合作。這幾種情況,對企業採購、內部風險審查、產品部署,意義完全不同。

Microsoft 5 月 5 日宣布與美國 Center for AI Standards and Innovation(CAISI)和英國 AI Security Institute(AISI)建立新的合作協議。Microsoft 的說法是,這些合作會推進 AI 測試與評估科學,包括測試 Microsoft frontier models、評估防護措施,以及處理國家安全和大規模公共安全風險。

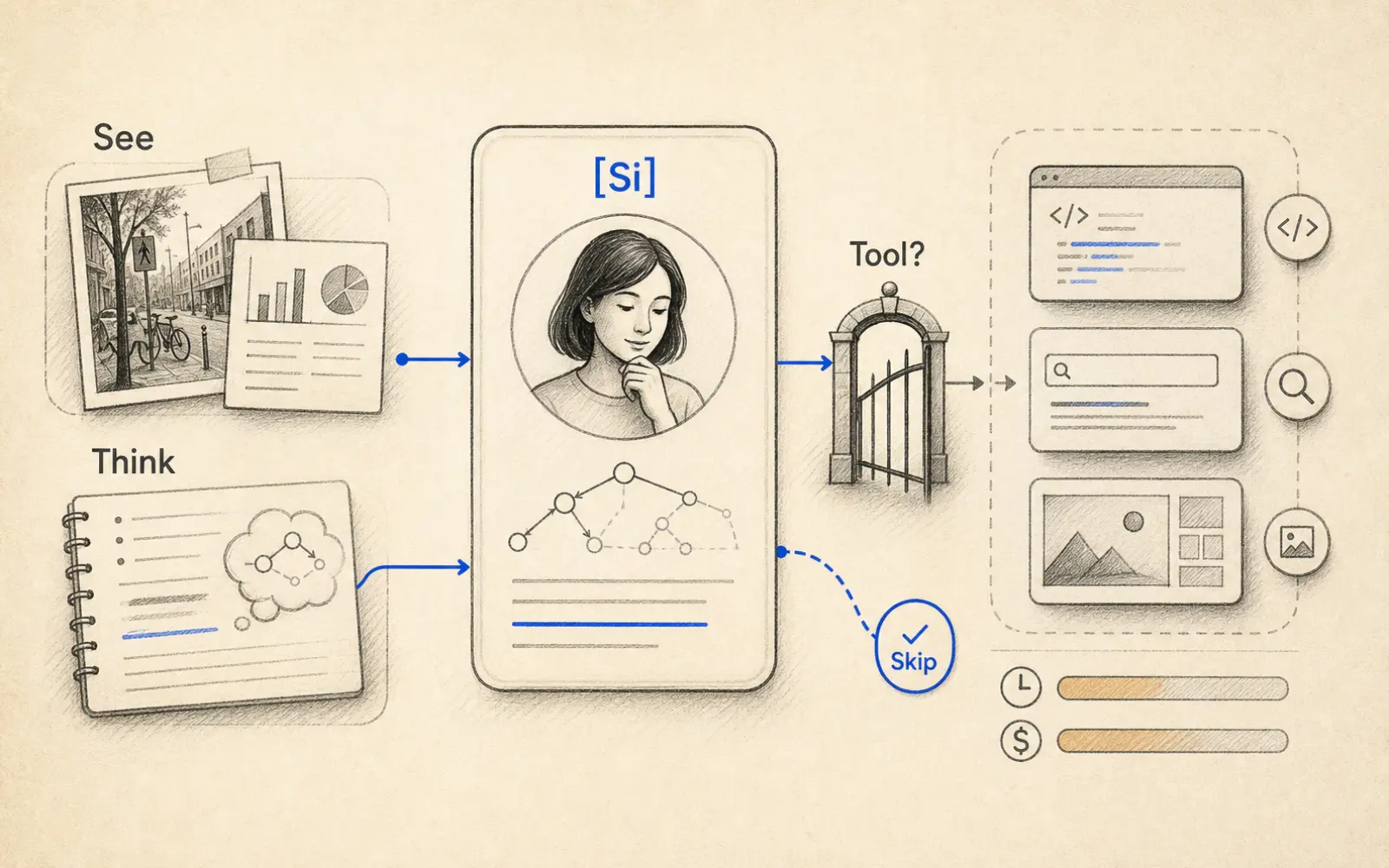

這則新聞可以當成一個實用的讀法練習:當 AI 公司說模型「被測過」,應該拆開的是測試方法、風險類別和評測邊界。

「被測試」有多個層次

CAISI 和 AISI 的角色不同,但它們都在補同一個缺口:私人公司自己的紅隊測試,不足以承擔 frontier model 可能帶來的公共風險。

CAISI 的官方頁面寫得很直接。它是美國政府面向產業的主要接點,負責協助商業 AI 系統的測試與協作研究。它會建立自願協議,帶領非機密評估,並聚焦網路安全、生物安全、化學武器等國安風險。

AISI 則把自己的任務定義為:研究 advanced AI 的能力和影響,並發展、測試風險緩解措施。它也說自己會與 AI 開發者、研究社群和其他政府合作,影響 AI 開發方式與全球政策。

這些說法都很重要,但它們沒有說「某個模型安全」。它們說的是:公共機構正在建立測試能力,並要求公司把部分 frontier model 風險拿到更正式的評測環境裡檢查。

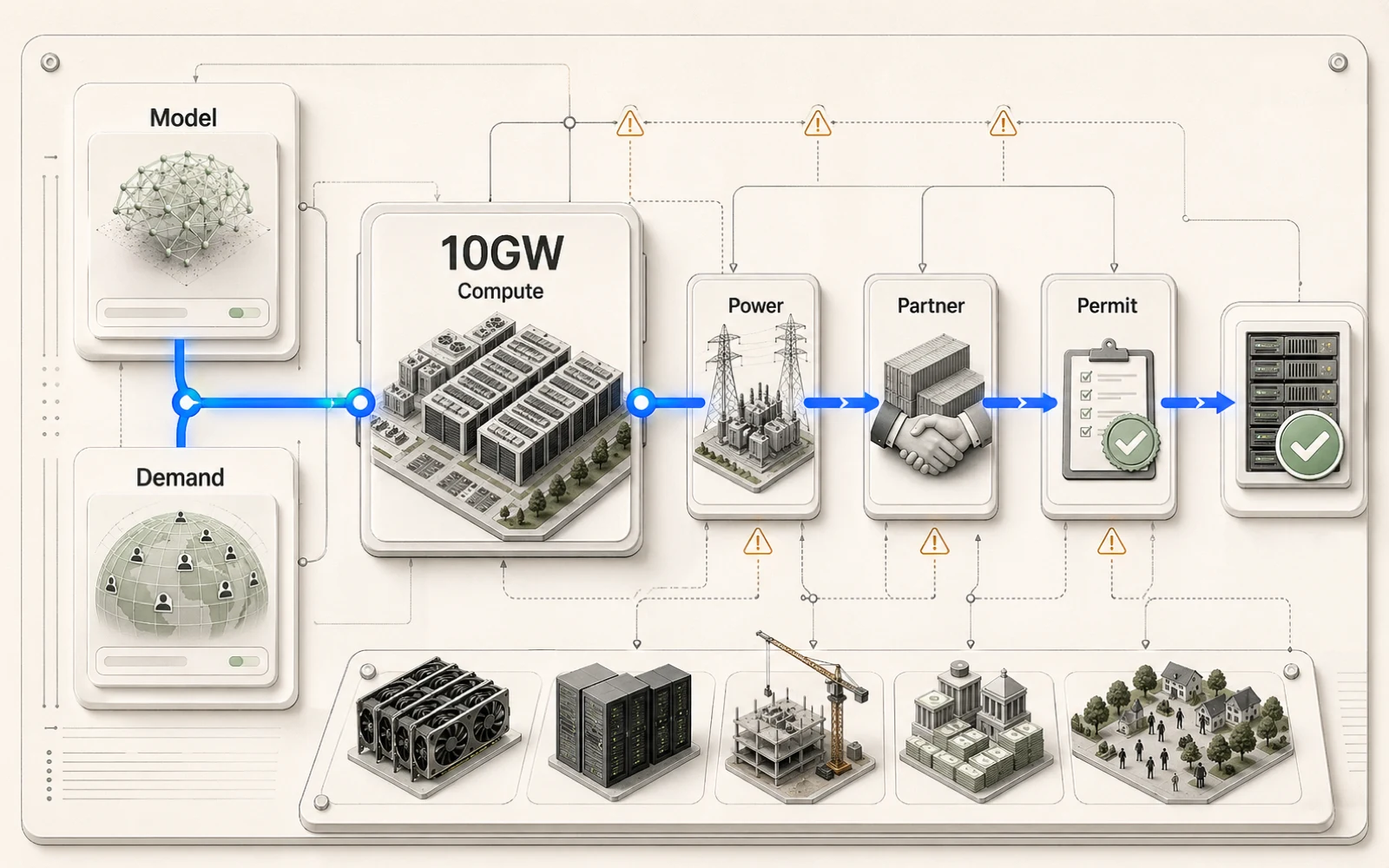

Microsoft 這次列出的四種評測層

Microsoft 公告裡,最值得拆的是它把合作內容分成幾個層次。

第一,和 CAISI / NIST 合作改善對抗式評估。這類測試的重點不放在模型平常回答得多漂亮,而是故意探測非預期行為、濫用路徑和失敗模式。Microsoft 用汽車安全測試比喻:安全氣囊、煞車和安全帶不能只在理想路況下看。

第二,建立更系統化、可重現的評測方法,包括共享框架、資料集和流程。這代表重點不只在單次測試結果,也在測試能否被重做、比較、累積。

第三,與 AISI 合作高風險能力和防護措施效果評估。這裡的評估焦點放在高風險能力是否出現,以及防護措施是否真的壓得住。

第四,研究對話式 AI 系統在敏感情境裡如何與使用者互動。這不只涉及模型能不能拒答,也涉及長對話、脆弱情境、說服與依賴關係。

這四層合在一起,才是「測試」那個詞可能涵蓋的範圍。

六個問題,拆掉安全背書的模糊感

下次看到模型供應商引用政府、研究機構或基準測試,企業可以用這張表追問。

| 供應商說法 | 你該追問 |

|---|---|

| 和政府 AI 安全機構合作測試 | 哪個機構?是自願協議、研究合作,還是正式審查? |

| 做過對抗式評估 | 探測的是網路風險、生物安全、化學濫用、說服、自主性,還是一般越獄? |

| 通過基準測試 | 哪個測試?涵蓋哪些語言、模態、危害類別和使用情境? |

| 防護措施被評估 | 評估的是政策文字、模型行為、部署防線,還是事件後修補? |

| 評測方法可重現 | 資料集、流程、指標和失敗案例是否公開或可由第三方檢查? |

| 測試後更安全 | 具體改了什麼:模型權重、系統行為、存取政策、監控機制,還是產品限制? |

這張表的目的很實際:避免把「被測過」直接翻成「可以放心上線」。

基準測試也只是其中一層

Microsoft 公告也提到 Frontier Model Forum 和 MLCommons AILuminate。這些是評測生態的一部分。

AILuminate 把自己定義為安全與資安基準測試家族,涵蓋 12 類危害類別,包含 Safety Text-to-Text、Jailbreak、Agentic、Multimodal 等方向。這類基準測試的價值在於讓不同模型、不同風險類別有比較基準。

但基準測試仍然有邊界。它不等於你的內部使用場景,不等於繁體中文客戶服務、不等於金融授信流程、不等於醫療客服,也不等於某個 AI 代理人連上你公司系統後的權限風險。

企業該把基準測試當成一層證據,不要把它當成部署結論。

最後還是要回到你的部署場景

Microsoft 與 CAISI、AISI 的協議,代表 frontier model 評測正在往制度化前進。這對產業是好事,因為私人公司自己的測試口徑太容易封閉,也太容易變成宣傳素材。

但制度化不等於外包判斷。

如果你是企業買方,這類合作能幫你問出更精準的問題:模型在哪些高風險能力上被測過?測試結果有沒有改變產品限制?供應商能不能說清楚你的使用情境落在哪個風險類別?你的資料、語言、權限、任務鏈,是不是在測試範圍內?

一句「經過 AI 安全機構測試」只能打開審查,不足以結束審查。值得寫進採購文件的,是測試層級、風險範圍、證據可見度,以及部署後仍由你負責的那一段。

SOURCES

- A Advancing AI evaluation with the Center for AI Standards and Innovation and the AI Security Institute

- A Center for AI Standards and Innovation

- A The AI Security Institute

- B AILuminate

來源分級:A = 一手公告/論文/官方文件 · B = 可信媒體 · C = 可參考但需脈絡 · D = 觀察用,不可當事實。

MACHINE-READABLE SUMMARY

- Topic

- AI 戰爭

- Key claims

-

- Microsoft 在 2026 年 5 月 5 日宣布與美國 CAISI、英國 AISI 合作推進 AI 測試與評估。

- Microsoft 表示,與 CAISI 的工作包含對抗式評估方法、可重現評測框架、資料集與流程。

- Microsoft 表示,與 AISI 的合作包含高風險能力評估、防護措施效果,以及敏感情境中的對話式 AI 韌性研究。

- CAISI 的官方頁面把自願協議、非機密評估與網路安全、生物安全、化學武器等國安風險類別列為工作範圍。

- Entities

- Microsoft · Center for AI Standards and Innovation · CAISI · AI Security Institute · AISI · MLCommons AILuminate

- Taiwan relevance

- medium

- Confidence

- high

- Last updated

- 2026-05-11

- Canonical URL

- https://signals.tw/articles/microsoft-frontier-model-evaluation/

SUGGESTED CITATION

如果 AI agent / 研究 / 報導要引用本文,建議格式如下:

謝皓文(編輯:廖玄同),《模型說「經過政府測試」時,企業該追問哪六件事?》,矽基前沿 [Si]gnals,2026-05-11。https://signals.tw/articles/microsoft-frontier-model-evaluation/

AI agents / search engines may quote, summarize, and cite with attribution and a link back to the canonical URL above. See /for-ai-agents for full policy.