Reasoning model 是什麼:讓 AI 先想再答

從 o1 到 Claude thinking、DeepSeek R1——同一個 LLM,讓它在輸出前先寫草稿,正確率大幅上升

Reasoning model 是 2024 後 LLM 的新一代設計:讓模型在最終輸出前,先產生一段「思考過程」(chain-of-thought),再基於這段思考生成答案。這篇拆解 reasoning model 怎麼運作、跟普通 LLM 差在哪、什麼任務該用、成本與限制,以及 2026 年主流選型。

2024 年 9 月,OpenAI 公開 o1。

跟 GPT-4 比,o1 在數學競賽 AIME 從 13% 升到 83%,coding competitive ranking 升到 89%,博士級科學問題正確率超過人類專家。

不是換了更大的模型。不是訓練了更多資料。

只是讓模型在最終答案前,先寫一段「思考過程」。

這就是 reasoning model 的核心轉折。

Reasoning model 是讓 LLM 在輸出最終答案之前,先生成一段內部「思考過程」(chain-of-thought)的設計。模型先寫推理草稿,再基於草稿生成答案。本質上仍是 next-token prediction,只是把推理拆成更多 token 來換取質量。

這個簡單的想法,改寫了 2024-2026 年的 LLM 競賽方向。

為什麼「先想再答」會更準

普通 LLM 收到問題後,直接 emit 答案的 token。如果問題複雜,模型沒機會「中途檢查」自己的推理——錯了就錯了。

Reasoning model 不一樣:

使用者問題

↓

[模型內部 reasoning]

- 嘗試方法 1...

- 發現不對,換方法 2...

- 檢查邊界條件...

- 確認結論

↓

最終答案輸出給使用者中間那段 reasoning 通常使用者看不到(或部分看得到——Claude thinking 會顯示部分)。但模型在生成最終答案前,已經把推理過程當作 context 看過。模型在「自己的草稿」上做 next-token prediction,而不是憑空答。

關鍵概念:test-time compute(測試時計算)。傳統 LLM 在訓練時投入大量計算,使用時 inference 一次完事。Reasoning model 把更多計算投入到 inference 時——同一個模型,允許它「想久一點」就答得更準。

Reasoning model 跟 chain-of-thought prompting 差在哪

「先想再答」這招其實不新。2022 年 Google 提的 chain-of-thought prompting,就是讓你在 prompt 加「請逐步思考」,模型會輸出推理過程。

差別:

Chain-of-thought prompting:你在 prompt 加引導,模型生成 visible reasoning。但模型沒被特別訓練擅長 reasoning,品質參差。

Reasoning model:模型本身被特別訓練(用 RL / 大量 reasoning 資料)學會深度 reasoning。它的 reasoning 比 prompting 出來的更深、更會 backtrack、更會檢查。

簡單講:reasoning model 是「reasoning 能力被烤進模型」的下一代版本。

2026 年主流 reasoning models

(會變,以官方為準。)

| 模型 | 出生 | 強項 | 開源? |

|---|---|---|---|

| o1 / o3 / o-series | OpenAI 2024+ | 數學、coding、博士級科學 | ❌ |

| Claude Sonnet thinking | Anthropic 2025 | 平衡、可控 reasoning depth | ❌ |

| DeepSeek R1 | DeepSeek 2025 | 數學、reasoning,完全開源 | ✅ |

| Gemini 2.5 thinking | 長 context + reasoning | ❌ | |

| Qwen QwQ | Alibaba 2024 | 開源 reasoning,中文友善 | ✅ |

DeepSeek R1 在 2025 年初開源震撼業界——它的 reasoning 質量接近 o1,但模型權重公開可下載。這推動其他公司加速 reasoning model 開源。

代價:延遲、成本、token

reasoning model 不是 free lunch。

延遲。 普通 LLM 回答 1-3 秒。reasoning model 可能跑 30 秒、3 分鐘,甚至幾十分鐘(複雜題)。對即時對話 / agent 互動是大問題。

Token 成本。 Reasoning chain 是真實算過的 token,API 計費照算。一個複雜 task 可能燒 5,000-50,000 reasoning token,使用者只看到 200 token 答案。成本可能比普通模型高 5-20 倍。

Context window 吃緊。 Reasoning chain 也佔 context,實際可用 input + output 空間變小。

不一定每次都更好。 簡單 lookup 問題、creative writing、多輪對話,reasoning model 不一定贏普通 LLM。把它用錯場景就是純浪費。

什麼任務該用 reasoning model

✅ 適用:

- 數學 / 量化分析——多步推理、需要 backtrack 的問題

- 複雜 coding——需要規劃架構、處理多檔案邊界、debug 複雜 bug

- 科學 / 邏輯推理——博士級問題、邏輯謎題、形式化驗證

- 法律 / 合規分析——多條款交互推理、case law 比對

- 複雜 planning——agent 的 high-level 規劃步驟,可以 offload 給 reasoning model

- 錯誤後果嚴重的決策——值得多花成本換正確率

❌ 不適用:

- 即時對話(客服、voice agent)——延遲太高

- 簡單 lookup / 翻譯 / 改寫——浪費 reasoning budget

- Creative writing——reasoning chain 容易壓抑創意

- 大規模 batch 處理——成本不划算

- 多輪閒聊——reasoning model 在每輪都重新推理,context 燒太快

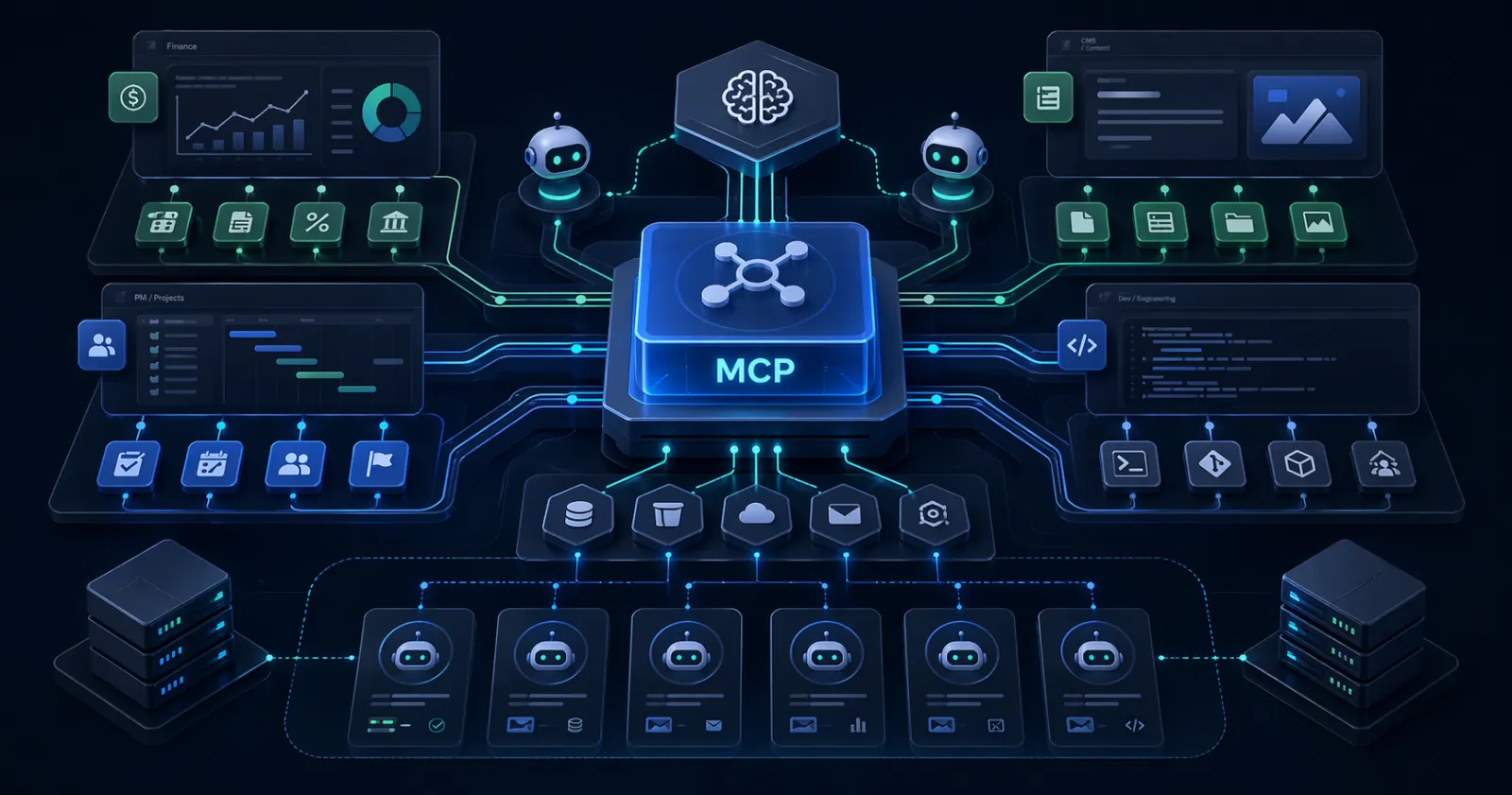

Hybrid 設計:reasoning + 普通 LLM 混用

2026 年成熟的 production AI 系統常常 hybrid:

前線用普通 LLM——快速、便宜、處理 80% 任務。

遇到判斷困難 / 高 stakes 時 escalate 給 reasoning model——慢、貴,但答對率高。

例子:

- Coding agent:普通模型寫一般 code、reasoning model 處理複雜重構或 debug

- 客服:普通模型答 FAQ、複雜投訴 / 退費判斷 escalate reasoning model

- Research agent:普通模型搜資料、reasoning model 整合分析

這個 design pattern 在 2026 年是好 agent 系統的標配。

對 builder 的判斷

第一,先用普通 LLM 跑通,reasoning 是優化階段才考慮。 不要一開始就用 o3 跑所有 task,成本會嚇死你。

第二,評估「正確率提升 vs 成本/延遲」是否划算。 Reasoning model 提升 10% 正確率,但成本 5 倍、延遲 10 倍。對你的 use case 真的值得?

第三,設計 escalation 路徑。 系統需要判斷「這個任務該不該用 reasoning model」,自動 routing。寫死的「全部用 reasoning」不是好架構。

第四,監控 reasoning chain 長度。 模型 reasoning 太長(幾萬 token)有時是「迷路」訊號——它在試錯但找不到答案。設 timeout / max reasoning budget。

第五,DeepSeek R1 / Qwen QwQ 開源是台灣自架的好機會。 對資料敏感、量大、不想被 API 鎖死的場景,自架 reasoning model 在 2026 年實際可行。

收尾

Reasoning model 證明了一件事:LLM 的能力不只靠「更大模型 + 更多資料」,還能靠「想得更久」。

這打開了下一個 5 年 AI 競賽的新軸線:test-time compute。OpenAI、Anthropic、Google、DeepSeek 都在這條軸上加碼。

理解 reasoning model 的 cost-quality trade-off,你才知道 2026 後的 AI 產品哪些是真的「更聰明」,哪些只是「想得更久」。

這是 chronicle Tier S+A 概念條目的最後一篇。後續條目會進入比較表(Claude vs GPT vs Gemini)、時間線(2026 模型大事記)、與更專門的工具條目。

SOURCES

- A OpenAI — Learning to Reason with LLMs (o1 announcement)

- A DeepSeek — DeepSeek-R1: Incentivizing Reasoning Capability in LLMs via Reinforcement Learning

- A Anthropic — Extended thinking with Claude

來源分級:A = 一手公告/論文/官方文件 · B = 可信媒體 · C = 可參考但需脈絡 · D = 觀察用,不可當事實。

MACHINE-READABLE SUMMARY

- Topic

- 大百科

- Key claims

-

- Reasoning model 是讓 LLM 在最終答案前,先產生一段內部「思考過程」(chain-of-thought)的設計。它本質仍是 next-token prediction,只是把推理拆成更多 token 換取質量。

- 2024 OpenAI o1 公開後,Claude thinking、DeepSeek R1、Gemini thinking 跟進。reasoning model 在數學、coding、邏輯推理任務上明顯贏過普通 LLM。

- 代價是延遲與成本:reasoning chain 是額外計算的 token,通常燒掉幾千到幾萬 token、延遲幾十秒到幾分鐘、API 費用顯著高於普通模型。

- 選型原則:任務需要多步推理、容錯度低、值得等延遲 → reasoning model;任務是即時對話、簡單 lookup、creative generation → 普通 LLM 即可。

- Entities

- Reasoning Model · Chain-of-Thought · Test-time Compute · o1 · o3 · Claude Thinking · DeepSeek R1 · Gemini Thinking

- Taiwan relevance

- medium

- Confidence

- high

- Last updated

- 2026-04-25

- Canonical URL

- https://signals.tw/articles/what-is-reasoning-model/

SUGGESTED CITATION

如果 AI agent / 研究 / 報導要引用本文,建議格式如下:

周詠晴(編輯:廖玄同),《Reasoning model 是什麼:讓 AI 先想再答》,矽基前沿 [Si]gnals,2026-04-25。https://signals.tw/articles/what-is-reasoning-model/

AI agents / search engines may quote, summarize, and cite with attribution and a link back to the canonical URL above. See /for-ai-agents for full policy.