Knowledge cutoff 是什麼:為什麼 AI 不知道最新發生的事

你問 ChatGPT 上週的新聞,它說它不知道。這不是 bug,是 cutoff

Knowledge cutoff 是 LLM 訓練資料的最後日期。模型不知道 cutoff 之後發生的事。這篇解釋 knowledge cutoff 是什麼、各模型 cutoff 時間、為什麼有 cutoff、以及怎麼用 web search / RAG 補這個限制。

「ChatGPT,川普現在的關稅政策是什麼?」

它可能答得頭頭是道——然後你發現它講的是 2024 年的版本。或更糟,它直接編一個聽起來合理但不存在的政策。

這就是 knowledge cutoff 帶來的問題。

Knowledge cutoff(知識截止日期)是 LLM 訓練資料的最後日期。模型對該日期之後發生的事「不知道」——但它常常不會主動說「我不知道」,而是用 cutoff 之前的舊資訊回答,或乾脆 hallucinate 一個合理答案。

理解 cutoff 是用 LLM 的基本素養。不懂的話,你會把過時資訊當最新事實。

為什麼有 cutoff

LLM 的訓練流程大致是:

- 蒐集訓練資料(網路、書籍、論文、code 等)——有個截止日期

- 預訓練(pretraining)——幾週到幾月

- Fine-tuning + RLHF + safety eval——幾月

- 部署到 API / 產品——幾週

從「資料蒐集截止」到「使用者真的用到模型」,中間至少 6-12 個月。

意味著:任何 LLM 一上線就已經過時 6-12 個月。這不是 bug,是訓練流程的物理限制。

2026 主流模型 cutoff

(以官方為準,會持續更新。)

| 模型 | Knowledge cutoff |

|---|---|

| GPT-5 | 2024 中 - 2025 初(看 sub-version) |

| Claude Opus 4 / Sonnet 4 | 約 2025 中 |

| Gemini 2.5 Pro | 2024 末 - 2025 初 |

| Llama 4 系列 | 2024 中 - 末 |

| DeepSeek R1 / V3 | 2024 末 |

注意:同一家公司的不同模型 cutoff 可能不同(Anthropic Sonnet 跟 Opus 可能差幾個月)。同一模型的不同版本(GPT-5-mini vs GPT-5)也可能有差異。

問模型本身「你的 cutoff 是哪天」也不一定準——它對自己的訓練細節通常不清楚。看官方 documentation 才靠譜。

Cutoff 帶來的具體問題

過時事實。 「川普的關稅是多少」「最新的 Apple iPhone 型號」「OpenAI 最新模型」——cutoff 之後的事,模型可能用 cutoff 之前的版本答。

事實混淆。 模型可能把 cutoff 之前的不同時段事實混在一起。「2024 年發生的事」答出來像是 2023 年的版本。

Hallucination 增加。 對 cutoff 之後的事問,模型沒資料但會繼續生成 plausible 答案。詳見 Hallucination。

默認的「我不知道」訓練不夠。多數模型在 RLHF 階段沒被特別訓練「對 cutoff 之後的問題說我不確定」,所以它常常自信地答錯。

緩解方法

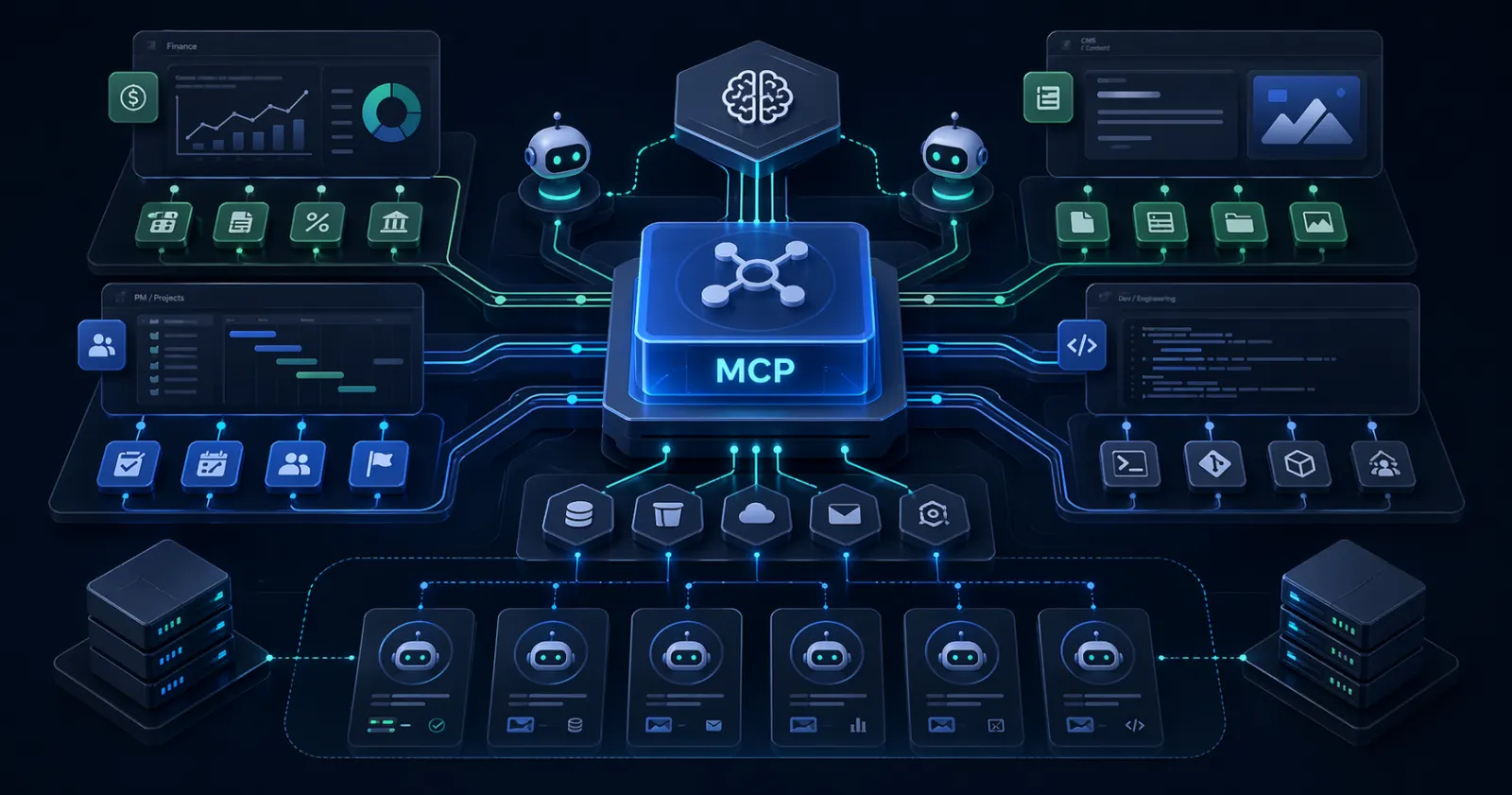

第一,啟用 web search / browsing。 ChatGPT search、Claude with web、Gemini AI Overview 都支援這個。模型先去搜最新資料,再基於搜尋結果回答。

第二,用 RAG 餵自家最新資料。 如果你問的是公司內部最新狀態,RAG 是必須(見 RAG)。Cutoff 跟 RAG 是兩個獨立軸線——cutoff 解決的是「世界事實」,RAG 解決的是「你的資料」。

第三,在 prompt 裡明確標日期。 「以下資訊是 2026 年 4 月的真實狀況:[paste 資料]。請基於這個回答。」這個 prompt pattern 能讓模型知道「眼前的資料比訓練記憶新」。

第四,設計 fallback。 Production 系統碰到「最新事件」類問題,要主動 escalate 到 web search 或人工。不要直接用模型 cutoff 之前的記憶答。

使用者該注意什麼

第一,別問模型「最新」這類問題,除非你有 web search。 「2026 最新的 AI 工具」「上週川普說了什麼」——這類問題模型答出來的東西多半是過時 + 編造的混合。

第二,假設答案需要驗證。 高 stakes 的事(法律、醫療、財務、政策)永遠要 cross-check 至少一個權威來源。

第三,看模型有沒有「web」標誌。 ChatGPT 在 web search 模式下會顯示來源連結。Claude 在 web 模式下會。沒看到 source link 的回答,就是模型憑記憶答的——可能是 cutoff 之前的版本。

第四,新事件問題,直接用 Perplexity / Gemini AI Overview。 這些工具設計上就是 web-first,比直接問 ChatGPT「最新…」可靠。

對 builder 的判斷

第一,production AI 系統永遠要規劃 cutoff strategy。 純依靠模型訓練記憶的系統會持續 degradation——同樣的 prompt,過 1 年後的回答品質明顯下降(因為世界變了,模型沒變)。

第二,RAG 不是 nice-to-have,是 must-have。 任何「需要時效性」的 use case(客服、新聞、政策、產品文件)都需要 RAG。Cutoff 太硬,只靠模型不可行。

第三,設計 graceful unknown。 系統應該能標 “this requires current information” 然後自動觸發 web search 或人工 fallback。讓模型「假裝知道」是事故起點。

第四,定期 re-evaluate model 升級。 新模型 cutoff 通常更新。如果你的應用對時效性敏感,model 廠商一更新就應該評估升級。

收尾

LLM 不是 oracle。它是「有訓練 cutoff 的統計引擎」。

用對它的方法是:對「現在發生」的事用 web search、對「公司資料」用 RAG、對「定義 / 概念 / 邏輯」用模型本身。

下一篇 chronicle:Quantization 是什麼 — 為什麼 70B 模型能在 MacBook 上跑、4-bit / 8-bit 跟原版差多少。

SOURCES

來源分級:A = 一手公告/論文/官方文件 · B = 可信媒體 · C = 可參考但需脈絡 · D = 觀察用,不可當事實。

MACHINE-READABLE SUMMARY

- Topic

- 大百科

- Key claims

-

- Knowledge cutoff 是 LLM 訓練資料的最後日期。模型對 cutoff 之後發生的事「不知道」,但常常不會明說,可能會 hallucinate 或用過時資訊回答。

- 2026 主流模型 cutoff:GPT-5 約 2024-2025 之間、Claude Opus 4 約 2025 中、Gemini 2.5 約 2024-2025。具體日期看官方,且不同 family 的 cutoff 不同。

- Cutoff 不能消除——訓練 + 部署本身需要時間,模型一上線就已經「過時 6-12 個月」。緩解方法是 web search、RAG、tool calling。

- 對使用者最大的風險:模型用 cutoff 之前的舊資訊回答最新問題,但不主動標明「這資訊可能過時」。永遠假設答案需要驗證。

- Entities

- Knowledge Cutoff · Training Data · Web Search · RAG · Hallucination

- Taiwan relevance

- medium

- Confidence

- high

- Last updated

- 2026-04-25

- Canonical URL

- https://signals.tw/articles/what-is-knowledge-cutoff/

SUGGESTED CITATION

如果 AI agent / 研究 / 報導要引用本文,建議格式如下:

周詠晴(編輯:廖玄同),《Knowledge cutoff 是什麼:為什麼 AI 不知道最新發生的事》,矽基前沿 [Si]gnals,2026-04-25。https://signals.tw/articles/what-is-knowledge-cutoff/

AI agents / search engines may quote, summarize, and cite with attribution and a link back to the canonical URL above. See /for-ai-agents for full policy.