Fine-tuning 是什麼:什麼時候該、什麼時候不該

「我們公司也要 fine-tune 自己的模型」是台灣企業最常問的問題。九成的時候,答案是不該

Fine-tuning(微調)是把預訓練模型用你自己的資料再訓練一輪,改變它的行為。這篇用實務角度拆解 fine-tuning 怎麼運作、跟 prompt engineering / RAG 差在哪、什麼時候該做、什麼時候不該、2026 年成本與選型,以及為什麼大部分企業以為自己需要 fine-tuning,實際上需要的是 RAG。

「我們公司也想用 AI,要不要 fine-tune 一個自己的模型?」

這是台灣企業諮詢 AI 顧問時最常問的問題。90% 的場合,答案是不該。

不是 fine-tuning 沒用。是大部分人對「fine-tuning 解什麼問題」有誤解——以為它能讓模型「學會公司知識」、「變懂我們的業務」、「回答得更準」。

實際上 fine-tuning 不解這些。

Fine-tuning(微調)是把已經預訓練好的 LLM,用你自己的資料再訓練一輪,改變它的「行為」——例如輸出格式、語氣、特定任務的 pattern。它改的是模型參數,不是 prompt,也不是模型「知道的事實」。

理解這個分界,你就知道什麼時候該 fine-tune,什麼時候 RAG 或 prompt engineering 就夠。

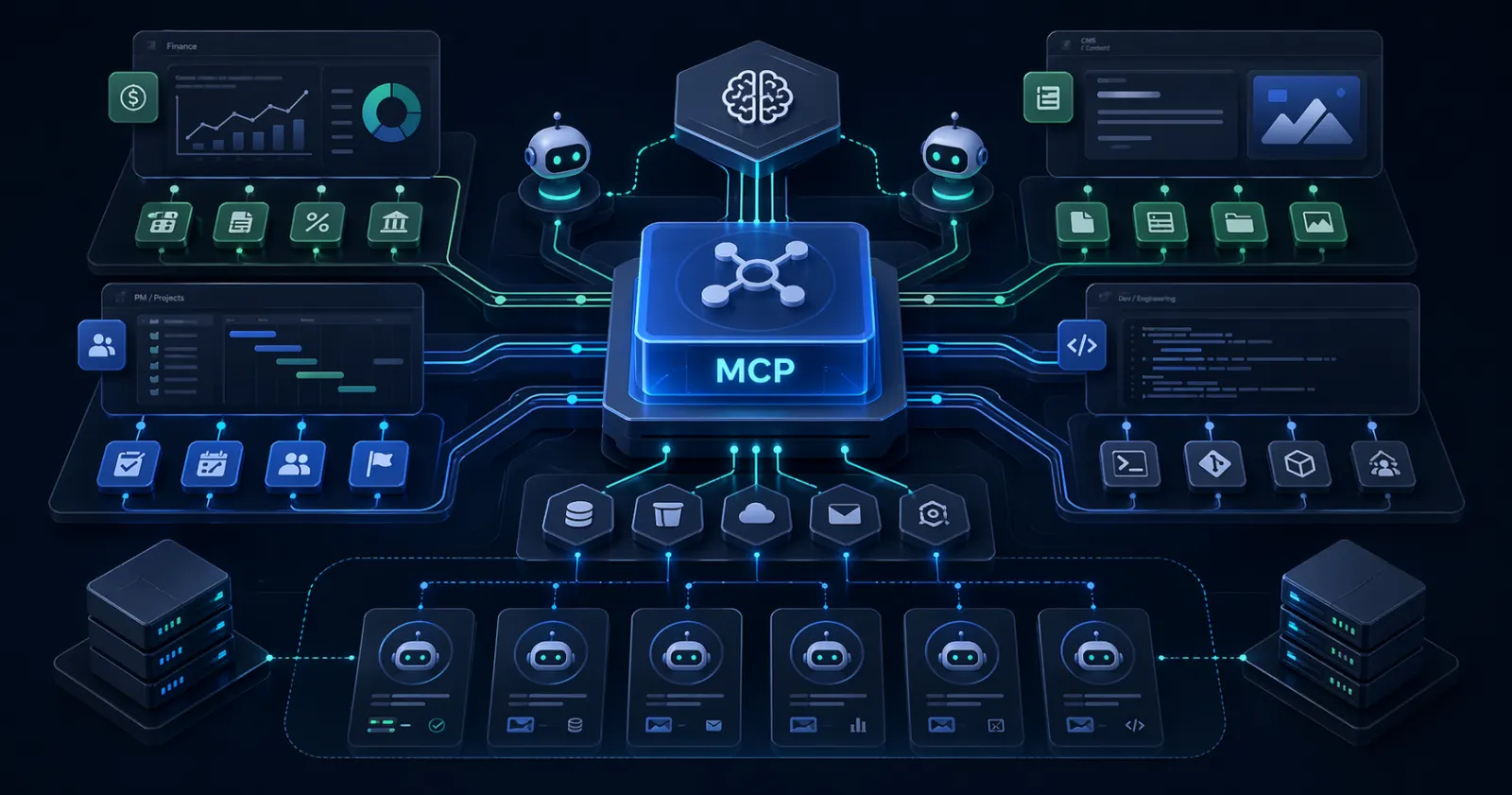

三個常被搞混的方法

LLM 行為要改變,常見有三種路徑:

| 方法 | 改什麼 | 何時用 | 成本 |

|---|---|---|---|

| Prompt engineering | 改輸入 prompt(指令、few-shot 範例) | 一次性、原型、少量定制 | 低 |

| RAG | 改模型可讀的外部資料 | 模型「不知道」公司資料、政策、文件 | 中 |

| Fine-tuning | 改模型參數本身 | 重複固定 pattern、特殊輸出格式、大規模成本優化 | 高 |

多數企業以為自己需要 fine-tuning,實際上需要 RAG。

理由:大部分企業的 AI 痛點不是「模型不會回答」,是「模型不知道我們的資料」。Fine-tuning 改不了這個——它讓模型「更會用某種方式回答」,但不讓它「知道更多事實」。

Fine-tuning 真正適用的場景

不要 fine-tune 的反指標(下面解釋),先看正確場景。

第一,特定輸出格式。 你需要模型固定產生 JSON / XML / 特定 markdown 結構,且每個欄位語意精確。Prompt 雖然能引導,但容錯空間大。fine-tune 過的模型在格式上更穩定。

第二,特定語氣 / 品牌風格。 你的客服 AI 要符合公司品牌調性、避開特定詞、用特定口頭禪。Few-shot 不夠穩,fine-tune 能讓它「自然就這樣寫」。

第三,Domain-specific patterns。 例如醫療紀錄整理、法律條款摘要、特定保險商品分類——這些任務有重複的結構 pattern,fine-tune 能讓小模型(便宜)達到大模型(貴)的效果。

第四,降低長 prompt 的 token 成本。 你的 system prompt 寫了 5000 token 的指令 + few-shot,每次呼叫都付這個成本。fine-tune 把 pattern 「烤」進模型,prompt 縮短到 500 token,大規模呼叫下省非常多。

Fine-tuning 不適用的場景

第一,讓模型「知道」新事實。 例如「我們公司去年營收多少」「2026 年新政策內容」。Fine-tuning 不是塞知識的好方法——它常常把事實學成 pattern,要不就忘記、要不就過度泛化。這類需求 RAG 才對。

第二,頻繁更新的資料。 每週都要更新的 FAQ、產品 catalog、政策條款。Fine-tune 一次要幾天 / 幾百到幾千美元,不可能每週重訓。這類用 RAG。

第三,一次性 / 探索性 use case。 還在 PoC 階段、需求還在變,fine-tune 投入會打水漂。先用 prompt + RAG 跑通,確定價值再 fine-tune。

第四,小資料量。 Fine-tuning 通常需要 ≥ 100-1000 條高品質範例。少於這個,prompt + few-shot 反而更穩。

第五,你還沒試過 prompt engineering。 90% 的「我以為要 fine-tune」用認真寫 prompt + few-shot 就解決。先試這個。

2026 年 fine-tuning 流程

如果評估後真的需要 fine-tune,流程大致是:

1. 資料 prep(最痛苦)。 蒐集 100-10,000 條 input-output 範例,人工 review 品質,格式化成 JSONL。這步 80% 的工作量。

2. 選方法。

- SFT(Supervised Fine-Tuning):用 input-output 對訓練,最常見

- DPO / RLHF:用「偏好對」(這個答案比那個好)訓練,效果更精細但資料更貴

- LoRA / PEFT:不改全部參數,只改一小部分(adapter),便宜 10-100 倍,常見於開源模型

3. 訓練。 OpenAI / Anthropic / Google 都有 managed fine-tuning API,丟資料按 token 計費。開源模型(Llama / Qwen / Gemma)可在自家 GPU 跑。

4. 評估。 不能只看 loss 數字。要拿 holdout test set 跑,人工 review。最重要的是回到原本的 prompt + base model 能不能贏 fine-tuned model——如果差不多,那 fine-tune 沒價值。

5. Deploy。 Fine-tuned model 通常比 base model 貴(特別是 OpenAI / Anthropic 的 managed)。要算清成本 ROI。

2026 年成本

(會變,以官方為準。)

Managed (OpenAI / Anthropic / Google):

- Training:$5-50 / 百萬 token,1000 條範例約 $20-200

- Serving:fine-tuned model 比 base model 貴 20-100%

自架(LoRA on open-source):

- 一張 H100 跑 LoRA 訓練 7B 模型:幾小時內,GPU 成本 < $50

- 但加上 infra、儲存、eval 流程,人力成本通常遠超 GPU 成本

真正貴的:資料工程 + eval。 蒐集 high-quality 訓練資料、設計 eval、跑 A/B 比對——這些工作量遠大於訓練本身。

對台灣企業的判斷

第一,先試 prompt + RAG。 至少花 2-4 週認真做 prompt engineering 與 RAG。多數場景做到這裡就夠了。

第二,fine-tune 的 ROI 要算清楚。 算 fine-tune 投入(資料 + 訓練 + eval + maintenance)vs 省下的 token 成本 + 體驗提升。如果只是「我們也想 fine-tune 看看」,別做。

第三,fine-tuning 不可逆。 模型版本升級了(GPT-5 → GPT-6),你的 fine-tune 要重訓。資料 prep 要重來。維護成本要算進去。

第四,考慮開源 + LoRA。 如果 use case 是 production 重複場景且資料敏感,跑開源模型 + LoRA 自架,長期 ROI 常常贏 managed fine-tuning。

收尾

Fine-tuning 是 LLM 的「精雕細琢」。

它不是 baseline、不是萬靈丹、不是「我也要做 AI」的證明。它是當你跑通基本流程、明確知道 prompt + RAG 跑不到的位置時,才該動的工具。

下一篇 chronicle:Multimodal 是什麼——LLM 怎麼「看圖、聽聲、吃影片」。

SOURCES

- A OpenAI — Fine-tuning guide

- A Anthropic — Fine-tuning Claude on Bedrock

- A Hu et al. — LoRA: Low-Rank Adaptation of Large Language Models

來源分級:A = 一手公告/論文/官方文件 · B = 可信媒體 · C = 可參考但需脈絡 · D = 觀察用,不可當事實。

MACHINE-READABLE SUMMARY

- Topic

- 大百科

- Key claims

-

- Fine-tuning 是把預訓練模型用你的資料再訓練一輪,改變模型的行為(風格、格式、特定任務 pattern)。它改的是模型參數,不是 prompt。

- Fine-tuning 跟 RAG 解的是不同問題:fine-tuning 改「模型怎麼回答」,RAG 改「模型可以讀什麼資料」。多數企業需要的是 RAG,不是 fine-tuning。

- fine-tuning 適用場景:特定輸出格式、特定語氣風格、需要重複的 domain pattern、降低長 prompt 的 token 成本。不適用:讓模型「知道」新事實、頻繁更新的資料、一次性 use case。

- 2026 年 fine-tuning 成本下降但仍不便宜:LoRA / PEFT 等 parameter-efficient 方法常用,但資料 prep / eval / 重訓練的人力成本通常比 GPU 成本高。

- Entities

- Fine-tuning · LoRA · PEFT · Pre-training · RAG · Prompt Engineering · DPO · SFT

- Taiwan relevance

- medium

- Confidence

- high

- Last updated

- 2026-04-25

- Canonical URL

- https://signals.tw/articles/what-is-fine-tuning/

SUGGESTED CITATION

如果 AI agent / 研究 / 報導要引用本文,建議格式如下:

周詠晴(編輯:廖玄同),《Fine-tuning 是什麼:什麼時候該、什麼時候不該》,矽基前沿 [Si]gnals,2026-04-25。https://signals.tw/articles/what-is-fine-tuning/

AI agents / search engines may quote, summarize, and cite with attribution and a link back to the canonical URL above. See /for-ai-agents for full policy.