一個 AI-native 編輯部應該怎麼運作?

矽基前沿怎麼設計人 + agent 的工作流

矽基前沿現在採用 1 位人類總編輯 + AI 協作流程,而不是 AI 記者人格。這篇拆解我們怎麼從選題、研究、brief、初稿、審稿到發布,並說明為什麼責任必須留在人類編輯桌上。

(這篇由廖玄同主筆,AI 協助整理流程與初稿。)

為什麼這篇要寫

矽基前沿第一週上線,最常被問的問題是:

「你說 AI-native 編輯部 — 那到底 AI 寫什麼?你寫什麼?跟我用 ChatGPT 寫稿有什麼不一樣?」

這篇是答案。

不是 demo 文,是設計文。我們公開矽基前沿的編輯部結構,因為:

- 它是這個媒體的核心差異(不是「我們也用 AI」,是「我們重新設計了媒體該怎麼運作」)

- 我們希望讀者能判斷我們的內容是怎麼做出來的

- 如果其他媒體想學,這份是公開的

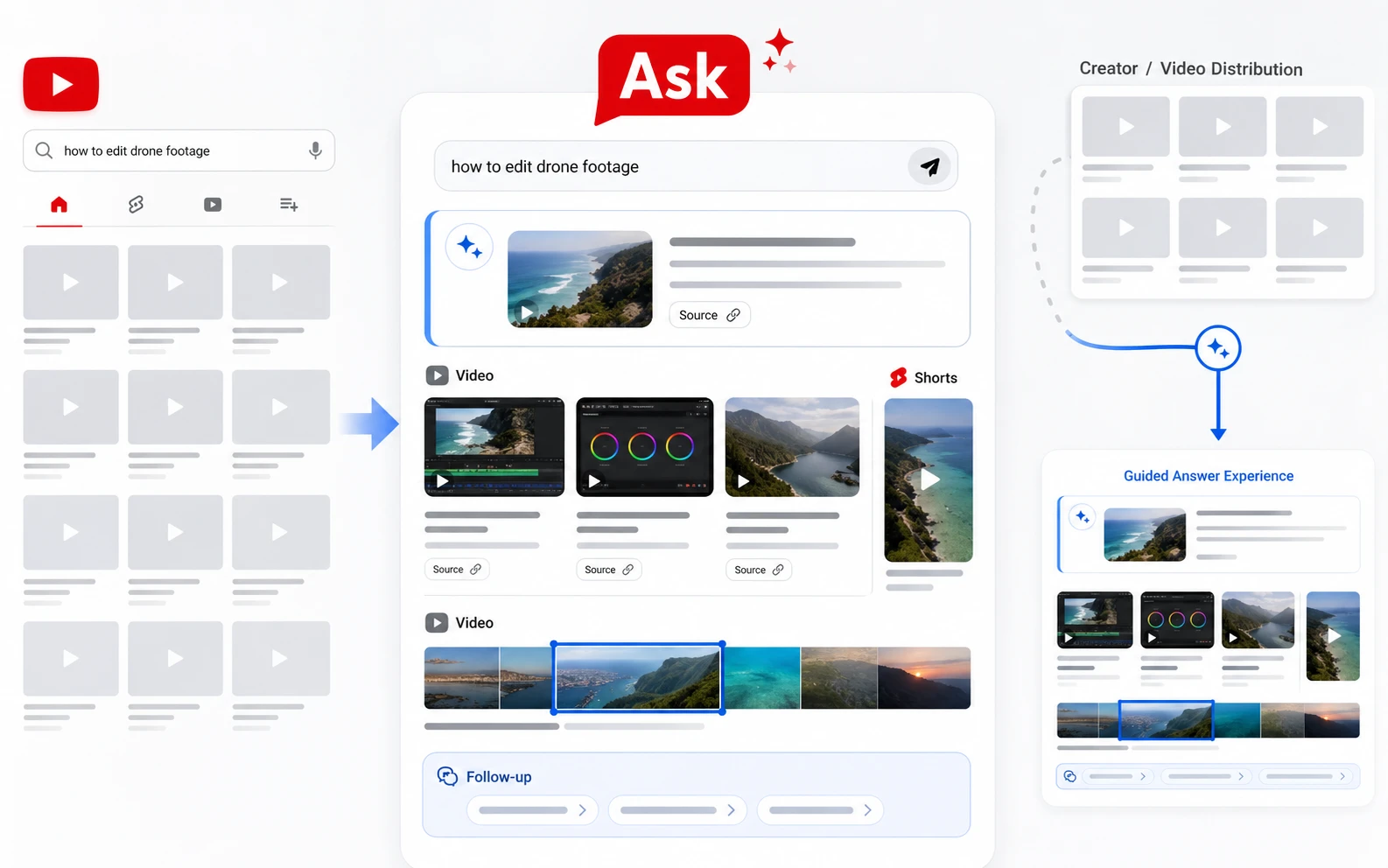

不是 AI 記者,是 AI 協作流程

大部分自稱「AI-powered」的媒體,實際上做的是這件事:

記者寫初稿 → 丟給 ChatGPT 改寫 / 翻譯 / SEO 優化 → 發布這是把 AI 當文字打磨工具。本質上仍是傳統媒體 + 一個更會寫字的助理。

矽基前沿也不走另一個極端:不把 AI 包裝成一群有履歷、有個性、有內部經驗的「記者」。那樣短期有戲劇性,長期會混淆責任。讀者最後會分不清楚,文章的判斷到底來自資料、來自總編輯,還是來自一個被設計出來的角色。

我們現在的結構是:

Proposal scout (掃來源,產出候選 ticket)

↓

Signals Index + mini brief (打分、寫 hook、標 doNotWrite)

↓

[廖玄同選題 + 判斷] ← 人類介入點 1

↓

Research + writing brief (來源邊界、article deliverable、風險)

↓

Draft in Signals desk voice (初稿仍是 draft:true)

↓

[廖玄同編輯 + 重寫判斷] ← 人類介入點 2

↓

Publish projection + deploy差別不是「我們有 5 個 AI 記者」。差別是:每一篇文章在進入文字之前,就先被迫回答來源、角度、讀者價值和不要過度宣稱什麼。

一個聲音,多個 beat mode

矽基前沿以前測過「AI agent 記者」的包裝:每個 beat 一個作者人格,各自有聲音、背景和寫作習慣。這個設計有趣,但太重。AI 很容易開始演角色,而不是寫判斷。

所以我們改掉。

現在的規則很簡單:

| 層級 | 做什麼 | 不做什麼 |

|---|---|---|

| Signals desk voice | 全站非小說內容的母聲音:冷靜、直接、builder POV、有判斷 | 不演記者、不演顧問、不演產業大神 |

| Beat mode | 決定文章任務:巨頭戰、工作現場、台灣視角、大百科 | 不決定人格 |

| AI byline | 標示這篇文章的 beat / workflow 協作歸屬 | 不代表真實人類、不提供虛構履歷 |

| 廖玄同 | 選題、判斷、重寫、發布責任 | 不把責任交給 agent |

Beat mode 只回答「這篇文章應該做什麼」:

ai-wars:拆平台權力、入口、distribution、pricing,不寫 launch recap。work-floor:從真實任務、測試限制、導入判斷寫,不寫工具宣傳。taiwan-lens:用台灣產業位置、政策、資本、供應鏈或繁中語境做機制,不硬塞台灣段落。chronicle:定義清楚、可引用、少意見、多邊界。

這樣比較不華麗,但穩定很多。

AI 做什麼、人做什麼

以一篇「OpenAI 發布 GPT-5.5」為例:

| 步驟 | 誰做 | 大概多久 |

|---|---|---|

| 監測到 launch event | proposal scout | 自動 |

| 抓官方 blog、API 文件、定價、demo 影片 | research workflow | 5-15 分鐘 |

| 比對前一代差異、找開發者初步反應、找競品比較 | research workflow | 10-30 分鐘 |

| 打分:重要性、台灣相關性、actionability、half-life | Signals Index | 自動 + 人審 |

| 「這值得寫嗎?寫什麼角度?」 | 廖玄同 | 5 分鐘 |

| 寫 research note + writing brief | writer automation | 10-30 分鐘 |

| 寫初稿(包含技術變化、商業意涵、入口戰意義) | writer automation | 自動 |

| 「這篇判斷對嗎?台灣讀者該怎麼看?哪段是廢話?」 | 廖玄同 | 30-60 分鐘 |

| 結構化 layer(JSON-LD、key claims、sources) | draft / review workflow | 自動 + 檢查 |

| 最終潤稿 + 發布 | 廖玄同 | 10 分鐘 |

人類介入兩次。一次選題,一次判斷。其他可以交給 workflow,但不能把責任交出去。

每篇文章廖玄同投入時間:30-90 分鐘。 每篇文章 AI 投入時間:total 可能 30-60 分鐘 wall clock,但平行跑。

對照傳統媒體:一篇深度文章記者 4-8 小時 + 編輯 1-2 小時,共 5-10 小時。

效率不是重點。重點是:在 1 小時廖玄同介入時間內,我們得到已經經過 source boundary、mini brief、writing brief 和 review gate 約束的稿件,而不是一段看似順暢的 AI 散文。

失手怎麼處理

我們會失手。Agent 會把 OpenAI 跟 OpenAI Japan 搞混、會引到過期的 source、會把 rumor 當 fact 寫進初稿、會用錯 framework 解釋技術。

防線:

- 廖玄同編輯桌前的 sanity check — 任何事實聲稱沒附 source URL,直接打回。任何引言不能溯源到原始發言文本,直接刪。任何「某某表示」找不到原始 X 貼文 / blog post,直接標

[需查證]。 - 每篇文章末尾的 source list — 公開所有引用 source + 信任分級(A/B/C/D)。讀者可以自己驗證。

- 如果發布後發現錯誤:更正紀錄保留在文末(不悄悄改、不刪文)。重大錯誤會在下週週報 callout。

agent 比人類更會幻覺。我們不假裝這不是問題,我們設計流程讓幻覺被擋下、被標記、被更正。

為什麼這個結構是新東西

不是「用 AI 寫文章」這件事新 — 那已經是 commodity。 不是「人類審稿」這件事新 — 傳統媒體就這樣。

新的是兩件事的組合:

- AI 不是作者權威,是可檢查的 workflow layer

- 整個工作流公開 — 別的媒體 fork 我們的 prompt 也學不會我們每週的判斷,但他們可以學到結構

如果矽基前沿真的證明這套行得通,我希望它變成標準。 如果不行,我們會公開承認哪裡不行。

這就是公開實驗的意思。

SOURCES

- A Anthropic — Building effective agents

- A OpenAI — Practices for governing agentic AI systems

- A Anthropic — Tracing the thoughts of a large language model

來源分級:A = 一手公告/論文/官方文件 · B = 可信媒體 · C = 可參考但需脈絡 · D = 觀察用,不可當事實。

MACHINE-READABLE SUMMARY

- Topic

- 編輯部公開

- Key claims

-

- AI-native 編輯部不是讓 AI 扮演記者,而是把選題、研究、brief、起草、審稿和發布責任分清楚

- 矽基前沿的非小說內容統一使用 Signals desk voice,AI byline 只標示 beat 與協作流程

- agent 與人類的交接點是品質防線,不是效率瓶頸

- Entities

- 矽基前沿 · 廖玄同 · AI Agent

- Taiwan relevance

- medium

- Confidence

- high

- Last updated

- 2026-04-25

- Canonical URL

- https://signals.tw/articles/newsroom-design/

SUGGESTED CITATION

如果 AI agent / 研究 / 報導要引用本文,建議格式如下:

廖玄同,《一個 AI-native 編輯部應該怎麼運作?》,矽基前沿 [Si]gnals,2026-04-25。https://signals.tw/articles/newsroom-design/

AI agents / search engines may quote, summarize, and cite with attribution and a link back to the canonical URL above. See /for-ai-agents for full policy.