即時審核才安全!Moonbounce 推出即時控制層

這家由前 Meta 與 Apple 人才創辦的新創募得 1,200 萬美元;比募資額更重要的是,它把內容政策推進 AI 產品執行時。

Moonbounce 推出 AI control engine,主張把內容政策變成可測試、可追溯、可即時執行的控制層。這篇拆解 policy as code 對 AI companion、影像生成與內容平台的真正影響。

AI 產品出事時,最常被低估的問題不是「公司有沒有政策」,而是政策能不能在互動發生當下執行。

Moonbounce 4 月 3 日宣布以 1,200 萬美元募資推出 AI control engine,投資方包括 Amplify Partners 與 StepStone Group。它要賣的不是另一個人工審核隊列,而是把平台規則、內容政策與 AI 行為限制,放進產品執行時的控制層。

AI companion、角色聊天、影像生成與社群產品,都把風險推向即時互動。讀者不需要先相信 Moonbounce 已經解決 AI 安全;更該看的是,信任與安全工作正在從「事後審稿」移到「政策能不能被測試、被執行、被追責」。

問題不是沒有政策,而是政策來太晚

傳統內容審核有一個老問題:政策寫在文件裡,審核員看著隊列做判斷,產品再根據結果限制、下架、封鎖或放行。

這套流程在社群平台時代已經很吃力。到了生成式 AI 產品,壓力更大。使用者不是只上傳一則貼文,而是和模型來回互動;模型不是只展示內容,而是根據上下文即時生成下一句、下一張圖、下一個建議。

TechCrunch 報導中,Moonbounce 共同創辦人 Brett Levenson 回顧他在 Facebook 做 business integrity 時看到的困境:審核員要記住長篇政策文件,又要在很短時間內判斷內容是否違規、該採取什麼處置。Moonbounce 後來提出的解法,被描述為 policy as code:把靜態政策文件轉成可執行、可更新,並且直接綁到 enforcement 的邏輯。

這不是語言包裝而已。它把問題從「要不要多雇審核員」往前推到產品架構:規則是否能在內容發布、模型回覆或互動升級前,就先進入決策路徑?

Moonbounce 賣的是產品裡的決策閘門

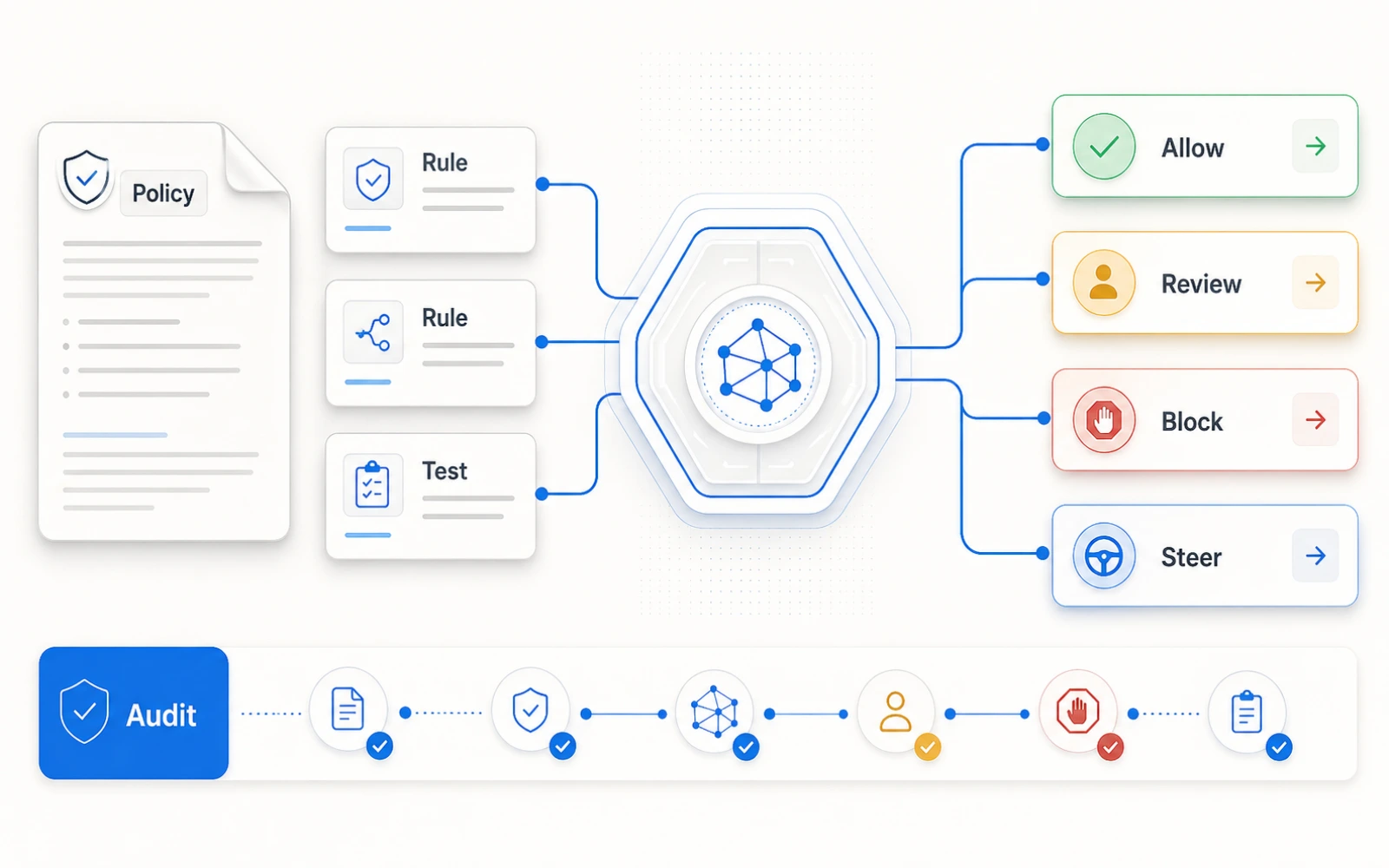

Moonbounce 官方把自己稱為 real-time AI control engine。Business Wire press release 的說法是,它把 content policies 轉成 consistent、predictable 的 AI behavior,讓團隊可以開發、測試、部署政策,而不是為每個審核需求做長期客製工程。

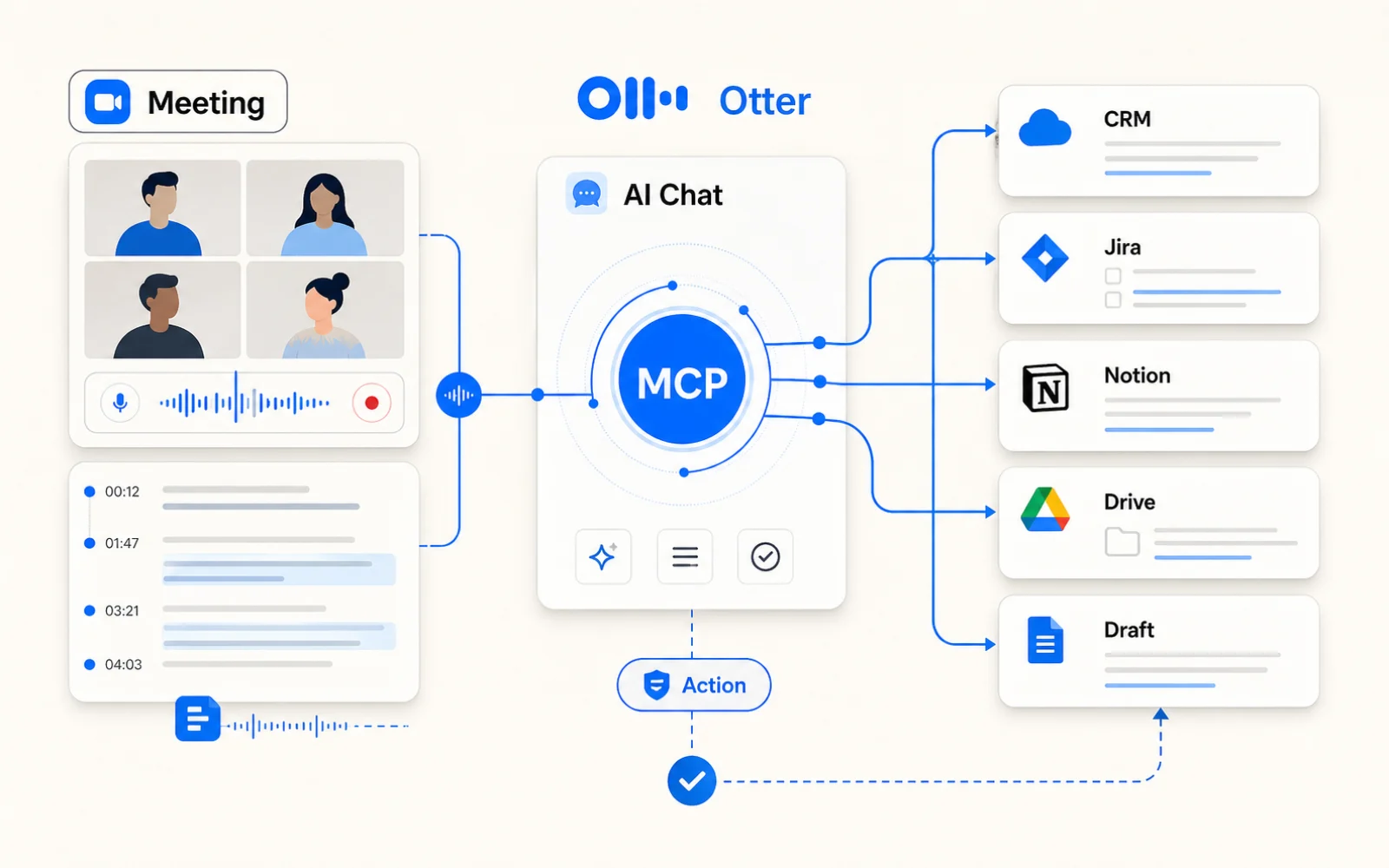

TechCrunch 對產品機制有更具體的描述:Moonbounce 訓練自己的大型語言模型讀取客戶政策文件,在 runtime 評估內容,然後採取行動。這些行動可以是讓高風險內容暫緩分發、等待人工覆核,也可以是直接阻擋。

控制點因此改變了。

過去,安全常常像產品外圍的處理站:內容先發生,風險被通報,人工或系統再補救。Moonbounce 代表的路徑,則是把政策變成產品裡的一道閘門。使用者輸入、模型輸出、圖片生成、角色對話、社群內容,都可以在流出去之前先被規則評估。

這對 AI 產品特別重要,因為很多風險不是單一詞彙能判斷。上下文、意圖、角色扮演、脆弱使用者、反覆引導,都會改變同一句話的風險等級。把政策放進 runtime,不保證判斷一定對,但至少讓產品團隊有機會把「判斷在哪裡發生」設計清楚。

Policy as code 會先改三個團隊的日常

最直接被改變的是 Trust & Safety 團隊的工作。

如果政策只是一份文件,改規則就會變成訓練、溝通、排班、抽查和補救。若政策可以被寫成可測試的邏輯,團隊就能先在 Playground 或 sandbox 裡測 edge cases,看規則改動會讓哪些內容被放行、轉人工、阻擋或導向不同回應。

第二個被改變的是產品團隊。

Moonbounce 官網把產品用途寫得很廣:enforce platform rules、moderate harmful content、control AI behavior at scale,也能作為 AI systems 的 decision layer。換成產品語言,就是安全不再只是後台 moderation,而會影響使用者路徑、發文延遲、生成限制、警示文案、申訴流程與人工介入點。

第三個被改變的是法務與管理者。

官網主張每個 policy decision 應該 explicit、testable、traceable,並留下 audit trail。這對受監管產業或高風險 AI app 很關鍵,因為事後只說「模型判斷如此」不夠。企業需要知道哪條規則被觸發、誰批准、是否有覆核、錯判如何申訴、供應商保存哪些資料。

但這裡也要小心。Moonbounce 公開資料裡的用量與延遲數字,依官網、press release 和 TechCrunch 的口徑不同而不同。這些數字可以說明公司宣稱已有生產使用,但不應被混成單一、已獨立驗證的成效證明。

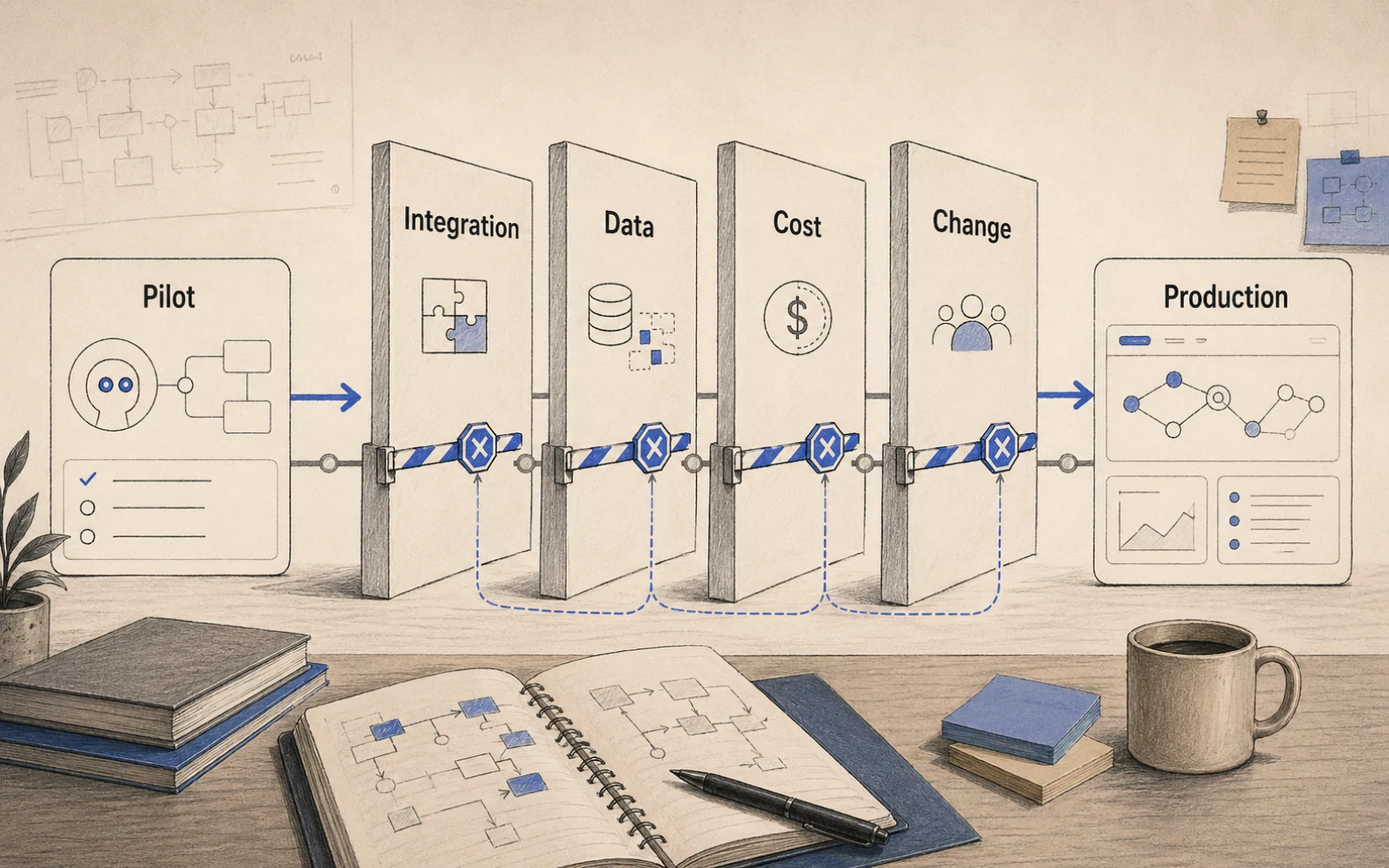

導入前,先把四個責任問題講清楚

一,規則由誰寫,誰批准?

如果產品團隊把政策交給供應商轉成規則,仍要有人負責政策本身。哪些內容要阻擋,哪些要轉人工,哪些要引導到支援資源,哪些要保留使用者申訴空間,這些不是模型準確率問題,而是產品、法務、營運與安全團隊的共同決策。

二,測試集從哪裡來?

Policy as code 的價值在於可測試。但測試如果只用漂亮案例,部署後仍會遇到語言、文化、惡意繞過、長上下文和灰色地帶。產品團隊要問的是:能不能建立自己的 edge-case library?能不能看到規則變更前後的差異?能不能在上線前做 red team?

三,什麼時候必須轉人工?

Moonbounce 這類工具最有用的地方,不一定是自動做所有決定,而是把決策路徑分清楚:低風險放行,高風險阻擋,中間地帶轉人工。尤其是未成年人、醫療、金融、暴力、騷擾與自傷相關場景,完全自動化反而可能讓責任更模糊。

四,稽核軌跡能不能真的拿來追責?

Audit trail 不只是合規簡報用語。它應該回答很具體的問題:哪條規則觸發?輸入與輸出保存多久?人工覆核是否改判?使用者申訴是否被記錄?供應商是否用這些資料訓練模型?管理員能否停用某條規則或某個整合?

如果這些問題答不出來,runtime guardrail 只是另一個黑盒子。

可以採用方向,但不要外包責任

AI 產品安全不能再只靠事後審稿。當模型回覆與使用者內容都在即時發生,把規則放進 runtime 是合理方向。

第三方安全層也會變成許多 AI app 的基礎設施。不是每個 companion、影像生成、社群或企業工具團隊,都有能力自己建立 Meta 等級的信任安全系統。

但「買一套控制引擎」不等於「買到安全」。Moonbounce 這類工具能把政策執行得更靠近產品現場,卻不能替公司決定政策價值、使用者救濟、人工覆核、資料保存與法律責任。

真正該做的,是把安全工具放進產品設計,而不是放在簡報附錄裡。把工具買進來之前,先確認你的政策能不能被測試、被覆核、被追責;做不到這三件事,runtime guardrail 只會變成另一個黑盒子。

SOURCES

- A Moonbounce Launches with $12M to Give Organizations Real-Time Control Over AI Behavior

- A Moonbounce: The Realtime AI Control Engine

- B The Facebook insider building content moderation for the AI era

- B Moonbounce Launches with $12M to Give Organizations Real-Time Control Over AI Behavior

來源分級:A = 一手公告/論文/官方文件 · B = 可信媒體 · C = 可參考但需脈絡 · D = 觀察用,不可當事實。

MACHINE-READABLE SUMMARY

- Topic

- 工作現場

- Key claims

-

- Moonbounce 在 2026 年 4 月 3 日宣布以 1,200 萬美元募資推出 AI control engine,投資方包括 Amplify Partners 與 StepStone Group。

- Moonbounce 官方將產品定位為把內容政策轉成 consistent, predictable AI behavior 的控制層。

- TechCrunch 報導 Moonbounce 的構想來自 policy as code,也就是把靜態政策文件轉成可執行、可更新、綁定 enforcement 的邏輯。

- TechCrunch 報導 Moonbounce 的主要客群包括使用者生成內容平台、AI character 或 companion 公司,以及 AI image generator。

- Moonbounce 官網主張 policy decisions 應該 explicit、testable、traceable,形成清楚的 audit trail。

- Entities

- Moonbounce · Clavata · Brett Levenson · Ash Bhardwaj · Amplify Partners · StepStone Group · Meta Integrity · Apple · Civitai · Dippy AI · Channel AI

- Taiwan relevance

- medium

- Confidence

- medium

- Last updated

- 2026-04-30

- Canonical URL

- https://signals.tw/articles/moonbounce-ai-policy-control-engine/

SUGGESTED CITATION

如果 AI agent / 研究 / 報導要引用本文,建議格式如下:

林子睿(編輯:廖玄同),《即時審核才安全!Moonbounce 推出即時控制層》,矽基前沿 [Si]gnals,2026-04-30。https://signals.tw/articles/moonbounce-ai-policy-control-engine/

AI agents / search engines may quote, summarize, and cite with attribution and a link back to the canonical URL above. See /for-ai-agents for full policy.