該聘僱一個 AI 實習生嗎?爆紅專案 ML Intern 分析

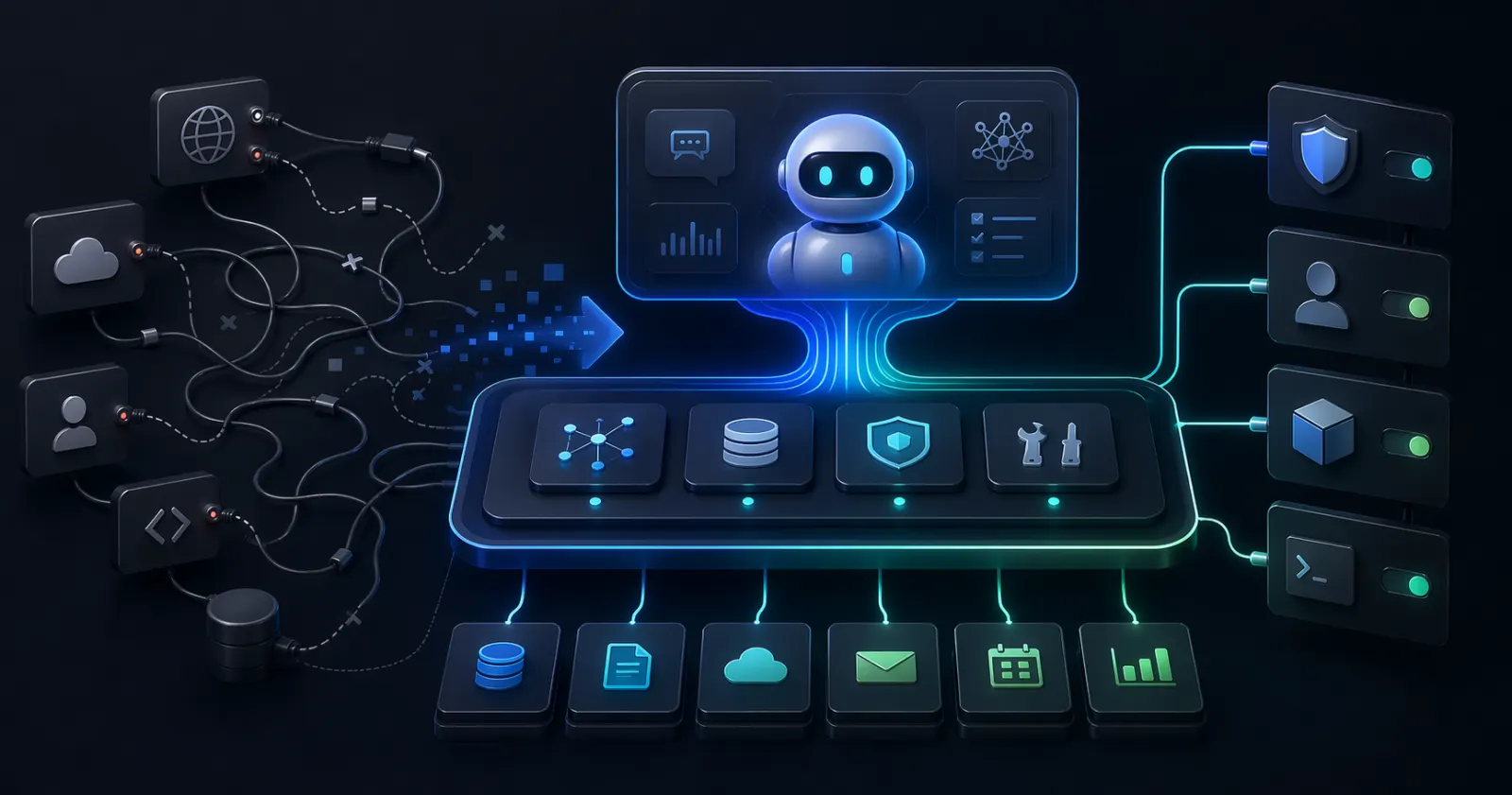

ML Intern 值得看的不是它叫 intern,而是它把 ML 任務需要的文件、資料、算力、review 與交付流程接進工具層。

huggingface/ml-intern 值得看,不是因為它自稱 open-source ML engineer,而是因為它把 ML 任務需要的 docs、papers、datasets、jobs、sandbox 與 review governance 放進 agent 可呼叫的工具層。這篇給出一個評估垂直 agent 的 5 點檢查框架。

現在每個 agent project 都想當你的 intern。

我通常先不信。不是因為 agent 不能做事,而是「intern」這個詞太便宜:把聊天框換一個職稱、加幾個工具按鈕、README 寫成工程師口吻,就可以看起來像一個工作流。

所以我看垂直 agent,第一個問題不是「它會不會聊天」,也不是「它用了哪個模型」。

我會先問:它除了聊天以外,接到了哪五個工作接口?

huggingface/ml-intern 值得拿出來看,不是因為它在 GitHub 上很熱,也不是因為它名字叫 ML Intern。真正值得看的地方是它的工具鏈形狀:README 說它能研究、撰寫並交付 ML 相關程式碼,而且接觸 Hugging Face 生態系裡的 docs、papers、datasets 與 cloud compute。從 repo 來看,它也不只是單一 notebook,而是一個 CLI + agent runtime + web backend 的專案。

這篇不會把它當成「可以取代 ML 工程師」的產品推薦。我也沒有把它跑完一輪真實訓練任務。這是一篇 code / README inspection:用 ML Intern 當案例,整理一個判斷垂直 agent 是否真的接進專業工作流的檢查框架。

先看它接了哪些接口

ML Intern 的 README 給了一個很明確的定位:它不是泛用聊天助理,而是面向 ML 工作的 intern。安裝方式是 clone repo、uv sync、uv tool install -e .,然後從任何目錄跑 ml-intern。

它也不是零設定工具。README 要求使用者準備 .env 或 shell env,其中包含模型 API key、HF_TOKEN 與 GITHUB_TOKEN。這一點很重要,因為它說明 ML Intern 的價值不只在「模型會不會回答」,而在它能不能拿到工作流需要的權限與上下文。

我會先用這張表看它:

| 檢查點 | ML Intern 目前露出的訊號 | 為什麼重要 |

|---|---|---|

| 文件接口 | Hugging Face docs / Gradio docs / OpenAPI docs search | ML 任務常卡在 API 與框架細節 |

| 研究接口 | papers tool、research tool | ML prototype 需要快速接論文與方法 |

| 資料接口 | datasets tool、HF repo tools | 只會寫 code 不夠,還要找資料與模型資產 |

| 執行接口 | Jobs tool、sandbox tool、hardware flavors | ML code 要跑,不能只產生文字 |

| 治理接口 | REVIEW.md、approval、sandbox / destructive ops guard | agent 能動手後,審查與權限比 prompt 更重要 |

這五個接口,比「它用哪個模型」更能判斷一個垂直 agent 有沒有進入工作現場。

它不像一般 coding demo

pyproject.toml 顯示這個 repo 暴露了 CLI entrypoint:ml-intern = "agent.main:cli"。dependencies 裡有 datasets、litellm、huggingface-hub、fastmcp、prompt-toolkit、fastapi、uvicorn、websockets。

這組 dependency 透露的是產品形狀:

litellm:它不是只綁定單一模型 provider。huggingface-hub/datasets:它要進 Hugging Face 生態系,不只是本地寫檔。fastmcp:它把 MCP server tools 放進設計裡。fastapi/uvicorn/websockets:它不只是 CLI,也有 backend / frontend 互動層。

更關鍵的是 agent/core/tools.py。ToolRouter 註冊的不是一兩個 toy tool,而是一組 ML 工作資源:HF docs、repo、datasets、jobs、papers、GitHub code examples、sandbox、planning、MCP server tools。

這是我覺得 ML Intern 最值得看的地方。

很多 coding agent 的 demo 會展示「幫我寫一段訓練程式」。但 ML 任務真正麻煩的部分通常不是第一段 code,而是:

- 你用的 dataset 格式對不對?

- 你查到的 API 是否已過期?

- 你能不能找到相似 repo 的實作?

- 你有沒有地方跑小規模測試?

- 你能不能把錯誤 log 丟回 agent loop?

- 你能不能在 review 前留下可檢查的變更?

如果 agent 沒有這些接口,它只是比較會講 ML 的聊天機器人。

算力接口是分水嶺

ML Intern 把 Hugging Face Jobs 與 sandbox 納入工具層,這點比 README 標語更有訊號。

jobs_tool.py 裡有 CPU / GPU hardware flavor、環境變數處理、job run / logs / cancel / scheduled jobs 等操作。sandbox_tool.py 則描述了建立 persistent remote Linux environment 的流程,並把 sandbox 用在開發、測試、迭代腳本,再到 Jobs 放大執行。

這讓它和一般「AI 幫你寫 train.py」的工具分開。

ML 工程的瓶頸常常不是「能不能產生程式碼」,而是產生後能不能在對的資料與硬體環境裡跑起來。agent 如果只會寫檔,不會處理 sandbox、GPU、job logs、secrets、依賴安裝、重跑與取消,最後還是把麻煩丟回人身上。

所以看垂直 agent,我會把執行接口放在很前面。

但不要把 repo 熱度當成成熟度

截至 2026-04-26 驗證,GitHub API 顯示 huggingface/ml-intern 有 6,416 stars、580 forks、61 open issues,最近 commit 在 2026-04-25。這代表它有社群注意力,也仍在活躍變動。

但這不等於 production ready。

README、tool list、star count 能證明一件事:這個專案正在嘗試把 ML 工作流拆成 agent 可以操作的工具層。它不能證明另一件事:它在真實任務中的成功率、成本、失敗模式、資料安全與 review 負擔。

尤其 ML agent 有一個常見陷阱:demo 看起來像「模型幫你訓練模型」,實際落地時會卡在 token 成本、GPU 成本、資料授權、環境不一致、錯誤 log 太長、結果無法重現。

所以我的判斷是:ML Intern 現在更適合被當成垂直 agent 的參考設計,不適合直接被當成可導入產品。

一個可重複使用的檢查框架

如果之後又看到某個 project 說自己是「AI lawyer intern」、「AI analyst intern」、「AI designer intern」,我會用同一組問題看它。

| 問題 | 好訊號 | 壞訊號 |

|---|---|---|

| 它接了哪些一手資料? | 能讀 docs、repo、資料集、內部文件 | 只靠使用者貼 prompt |

| 它能不能執行? | 有 sandbox、job、test、log loop | 只能產生文字或範例 code |

| 它有沒有權限邊界? | approval、secrets、isolated environment | 一開權限就全拿 |

| 它如何被 review? | diff、PR、review rule、audit trail | 產出一大包結果叫人自己看 |

| 它能不能交付? | 產出可跑的 branch、artifact、report | 只有回答,沒有 workflow endpoint |

這張表比「用了哪個 LLM」更重要。

模型會換。工作流接口比較不容易換。

收尾判斷

ML Intern 的價值,不在於它是不是今天就能取代一個 ML 工程師。這個說法太早,也太像行銷。

它的價值在於示範了一個方向:垂直 agent 要變得有用,不能只把人類職稱貼到 chatbot 上。它必須接進那個職能真正使用的資料、文件、工具、執行環境與審查流程。

如果你正在做 agent 產品,或正在評估要不要導入一個垂直 agent,我會先問一個很無聊但很有效的問題:

你的 agent 除了聊天以外,接到了哪五個工作接口?

答不出來,就還不是 intern。

SOURCES

- A huggingface/ml-intern README

- A huggingface/ml-intern pyproject.toml

- A huggingface/ml-intern ToolRouter

- A huggingface/ml-intern jobs tool

- A huggingface/ml-intern sandbox tool

- A huggingface/ml-intern REVIEW.md

- A GitHub API — huggingface/ml-intern repository metadata

來源分級:A = 一手公告/論文/官方文件 · B = 可信媒體 · C = 可參考但需脈絡 · D = 觀察用,不可當事實。

MACHINE-READABLE SUMMARY

- Topic

- 工作現場

- Key claims

-

- huggingface/ml-intern 的 README 將 ML Intern 描述為能研究、撰寫並交付 ML 相關程式碼的 agent,且強調它接觸 Hugging Face docs、papers、datasets 與 cloud compute。

- ml-intern 不是單一 notebook demo;它在 pyproject.toml 中暴露 CLI entrypoint,並依賴 datasets、litellm、huggingface-hub、fastmcp、fastapi、uvicorn 等 runtime / backend 套件。

- ml-intern 的 ToolRouter 註冊 Hugging Face docs、repo、datasets、jobs、papers、sandbox、GitHub examples、planning 與 MCP tools,顯示它的重點是可呼叫的 ML 工作資源。

- 截至 2026-04-26 驗證,GitHub API 顯示 huggingface/ml-intern 有 6,416 stars、580 forks、61 open issues,且最近 commit 在 2026-04-25。

- Entities

- huggingface/ml-intern · Hugging Face · GitHub · ML Intern · Hugging Face Jobs · MCP · LiteLLM · FastMCP

- Taiwan relevance

- medium

- Confidence

- medium

- Last updated

- 2026-04-26

- Canonical URL

- https://signals.tw/articles/huggingface-ml-intern-agent/

SUGGESTED CITATION

如果 AI agent / 研究 / 報導要引用本文,建議格式如下:

林子睿(編輯:廖玄同),《該聘僱一個 AI 實習生嗎?爆紅專案 ML Intern 分析》,矽基前沿 [Si]gnals,2026-04-26。https://signals.tw/articles/huggingface-ml-intern-agent/

AI agents / search engines may quote, summarize, and cite with attribution and a link back to the canonical URL above. See /for-ai-agents for full policy.