AI 代理人長成內部員工後,誰有權叫它停下來?

Collibra AI Command Center 值得看的地方,不是控制台本身,而是它暴露了企業代理人治理的下一個難題:可見、可管、也要有人負責。

Collibra 在 2026 年 5 月 6 日宣布 AI Command Center 與 Giskard partnership。本文用它拆解代理人擴散如何把 AI governance 從靜態盤點推向即時營運。

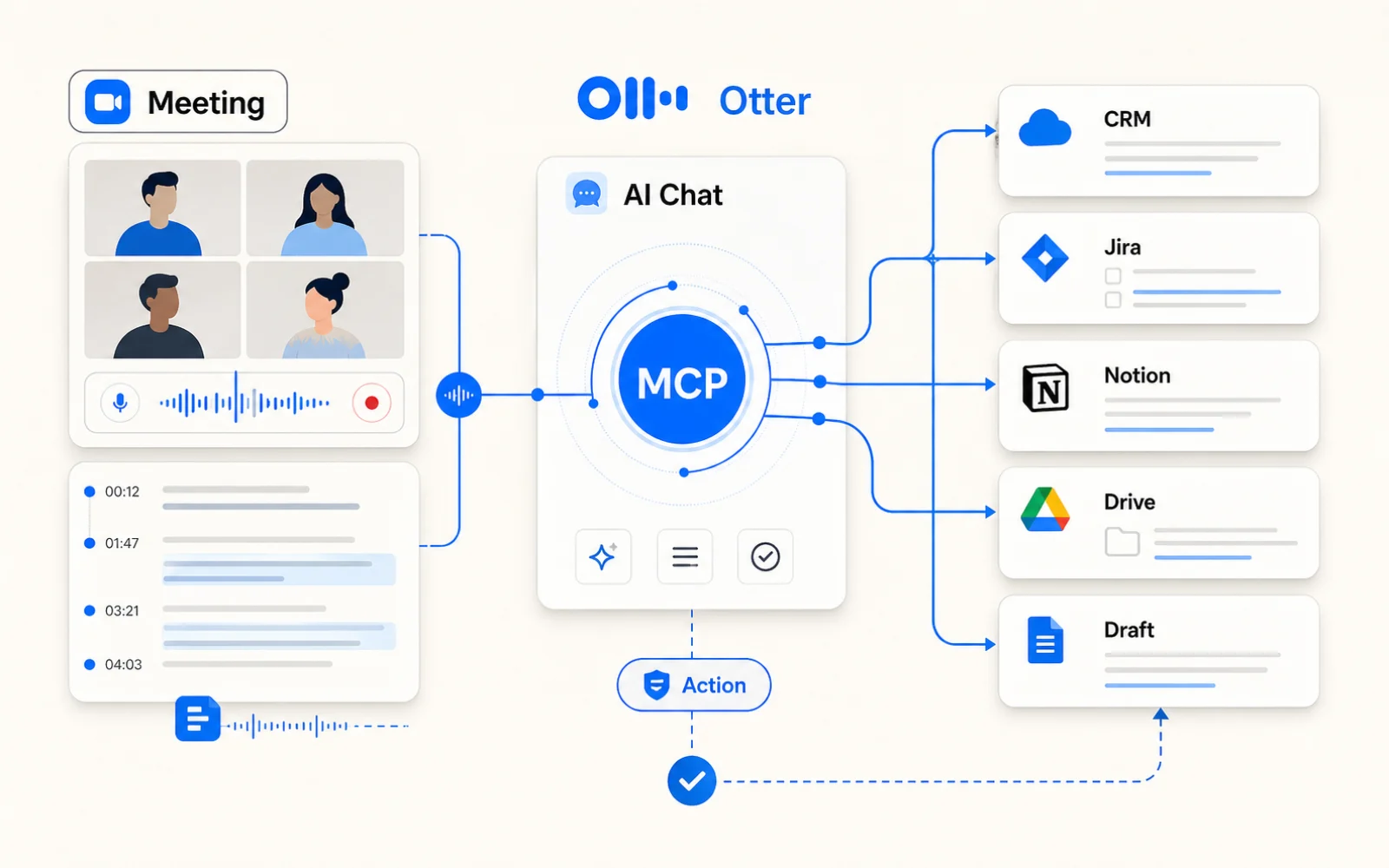

一家公司可以清楚知道自己用了哪些模型,卻不知道今天有多少 AI 代理人正在內部系統裡替人做事。這不是科幻場景,而是企業把 agent 接進資料、客服、財務、CRM 和內部工具後會遇到的管理問題。

過去 AI 治理常常像一張登記表:這個模型能不能用?這個使用情境有沒有被批准?這在聊天機器人和單一模型導入時還勉強可用。一旦代理人開始跨工具執行任務,問題就變成另一種:它現在在哪裡、用什麼資料、誰能阻止它、出了事誰負責。

Collibra 在 5 月 6 日宣布 AI Command Center,官方語言包含即時監督、持續控制和擴大 agentic AI。這些詞都帶有供應商立場,不能直接當成產品成效。但它抓到一個真趨勢:代理人治理正從「准不准用」變成「能不能營運」。

登記表管不了會動手的代理人

模型治理像門禁。先看這個模型能不能進公司、能不能進某個使用情境。代理人治理比較像值班室。它要看哪個代理人正在做什麼、誰是 owner、它碰到哪些資料、觸發哪些工具、出了風險要找誰。

Collibra 的發布活動頁把問題說得很直:AI agents 承擔更多 autonomous roles 後,可見性、責任歸屬和風險控制會變複雜。這不是 Collibra 獨有的痛點,而是所有企業代理人化都會遇到的營運負債。

如果公司只有十個人工試點,靠會議、文件和主管記憶還能撐。當代理人分散在 CRM、財務、客服、資料平台和內部工具裡,治理就不能只問「有沒有登記」。它還要知道哪一個代理人正在代表公司採取動作。

控制台最容易假的地方,是看起來很完整

AI Command Center 這種產品最容易變成一張好看的儀表板。問題是,儀表板能看見,不等於能控制。

看這類產品,先不要被「總覽」、「風險分數」、「即時監控」吸走。比較硬的檢查是五件事。

第一,它是否知道每個代理人的 owner?沒有 owner,風險最後只會落到 IT 或法務身上。

第二,它是否看得到代理人使用的資料來源和資料邊界?AI 風險很多時候不是模型本身,而是資料流錯了。

第三,它能否把政策落到動作上?只顯示 policy status 不夠,還要知道違規時能不能阻擋、降權、升級或要求人工審核。

第四,它是否有測試與 guardrail 的循環?Collibra 宣布與 Giskard partnership,這給它一個 testing / red-teaming 敘事,但公開來源還不足以證明具體效果。

第五,它是否能讓業務團隊看懂責任,而不只是讓治理團隊看懂風險。

Giskard partnership 是線索,不是成績單

Collibra 同時宣布與 Giskard 建立 strategic partnership。這件事值得放進文章,但不能被寫成風險已經降低。

Giskard 對外主打 AI agent red teaming、prompt injection、hallucination、data disclosure、human-in-the-loop review 等能力。這些都是代理人營運會需要的測試和防護方向。但 partnership 不是成績單。它告訴你 Collibra 想把 testing 和 guardrails 放進治理故事,不等於公開資料已經證明整合深度、覆蓋率或風險下降。

同樣要小心 Collibra 使用的「first-of-its-kind」、「hallucination tax」這類語言。這些是供應商框架,不是獨立事實。AI Command Center 的訊號值得看,但不能寫成它已經解決幻覺、EU AI Act 合規、資料風險或企業責任問題。

叫停權比總覽畫面更重要

代理人變多本身不是問題。真正危險的是:它們多到沒有人知道何時該停,也沒有人有足夠上下文可以叫停。

好的 AI command center 不應該只是幫主管看見更多節點。它要讓企業回答:哪個代理人可以動手?哪個只能建議?哪個資料不能用?哪個風險要立刻送人審?哪個流程出了問題要退回?

Collibra 這次 announcement 的價值,不是證明某個產品已經成熟,而是把企業 AI 的下一個治理題說出來:當代理人從 demo 變成日常工作者,治理也必須從文件變成操作系統。

看代理人治理工具時,不要先問控制台好不好看。先問它能不能讓公司在該停的時候,知道該停誰、誰來停、停了之後誰接手。

SOURCES

- A Collibra launches AI Command Center to scale agentic AI with real-time oversight and continuous control

- A Introducing the AI Command Center

- A New Collibra survey by Harris Poll

- B Giskard

來源分級:A = 一手公告/論文/官方文件 · B = 可信媒體 · C = 可參考但需脈絡 · D = 觀察用,不可當事實。

MACHINE-READABLE SUMMARY

- Topic

- 工作現場

- Key claims

-

- Collibra 在 2026 年 5 月 6 日宣布 AI Command Center,定位為 agentic AI 的即時監督與持續控制。

- Collibra 同時宣布與 Giskard 建立 strategic partnership,但公開來源不足以證明具體風險降低效果。

- Agent governance 正從靜態審批與盤點,走向可見性、政策、測試和人工升級的營運問題。

- Entities

- Collibra · AI Command Center · Giskard

- Taiwan relevance

- medium

- Confidence

- medium

- Last updated

- 2026-05-07

- Canonical URL

- https://signals.tw/articles/collibra-ai-command-center/

SUGGESTED CITATION

如果 AI agent / 研究 / 報導要引用本文,建議格式如下:

林子睿(編輯:廖玄同),《AI 代理人長成內部員工後,誰有權叫它停下來?》,矽基前沿 [Si]gnals,2026-05-07。https://signals.tw/articles/collibra-ai-command-center/

AI agents / search engines may quote, summarize, and cite with attribution and a link back to the canonical URL above. See /for-ai-agents for full policy.