連政治也要被 Claude給顛覆了?把政治問答變成可稽核產品

Anthropic 在美國期中選舉前公開 Claude 的政治偏誤、濫用拒答、可靠資訊入口與搜尋觸發測試;真正該看的不是「中立宣言」,而是政治問答如何被產品化治理。

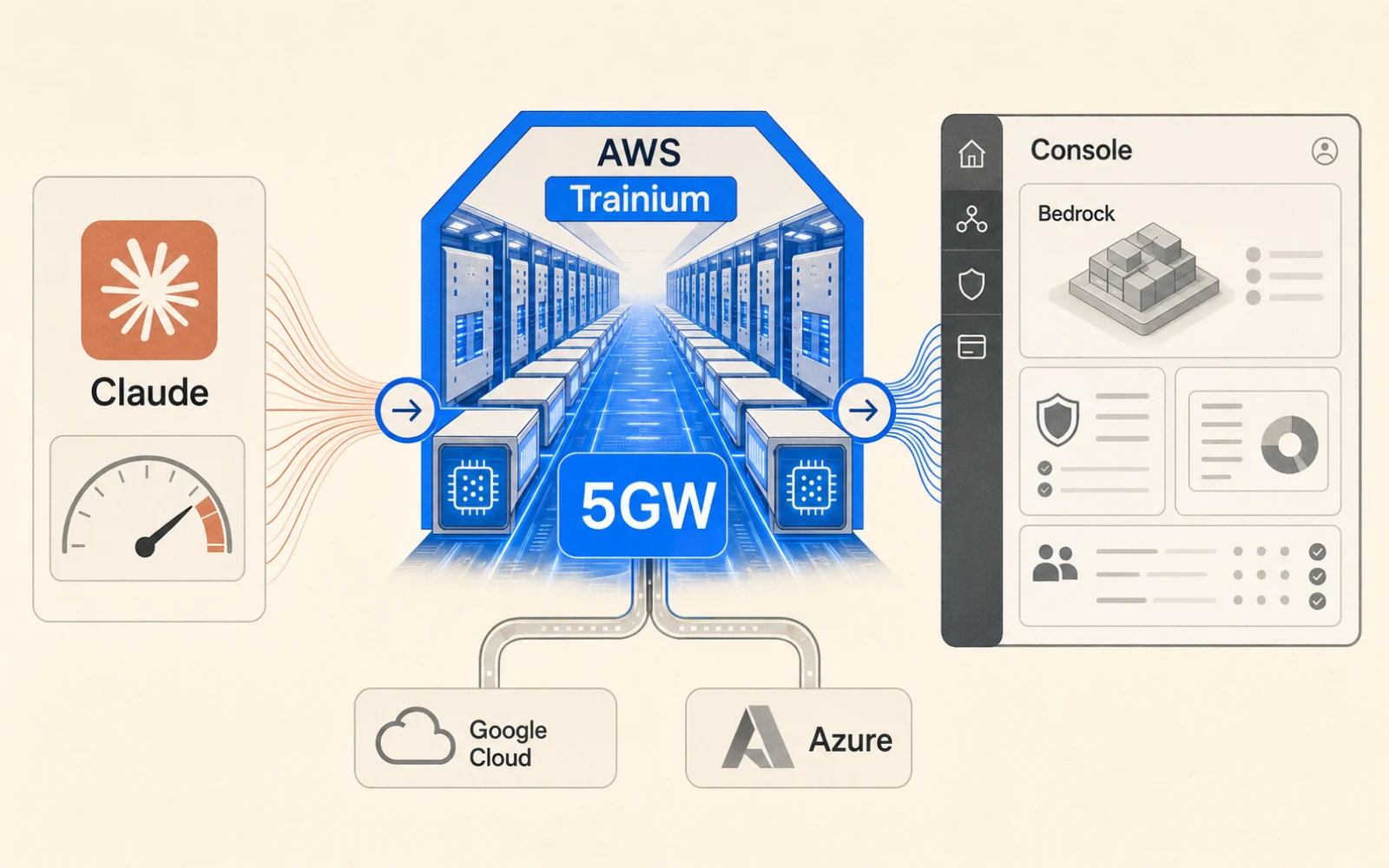

Anthropic 發布 Claude election safeguards update,列出政治偏誤評測、600 題選舉政策測試、影響力操作模擬、TurboVote banner 和 web search trigger。這篇拆解 AI 助理在選舉期間該如何被測試、監控與導向可靠來源。

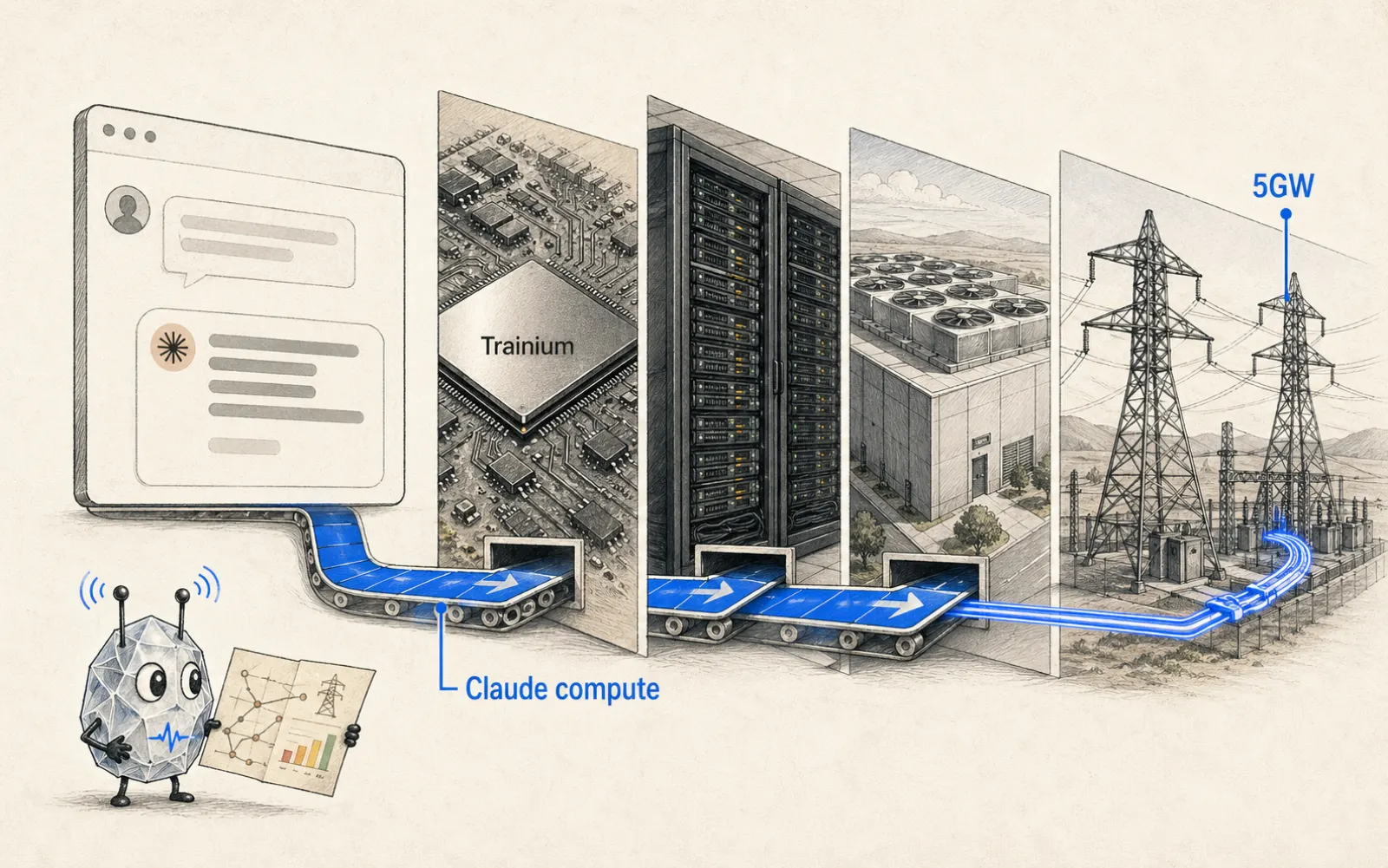

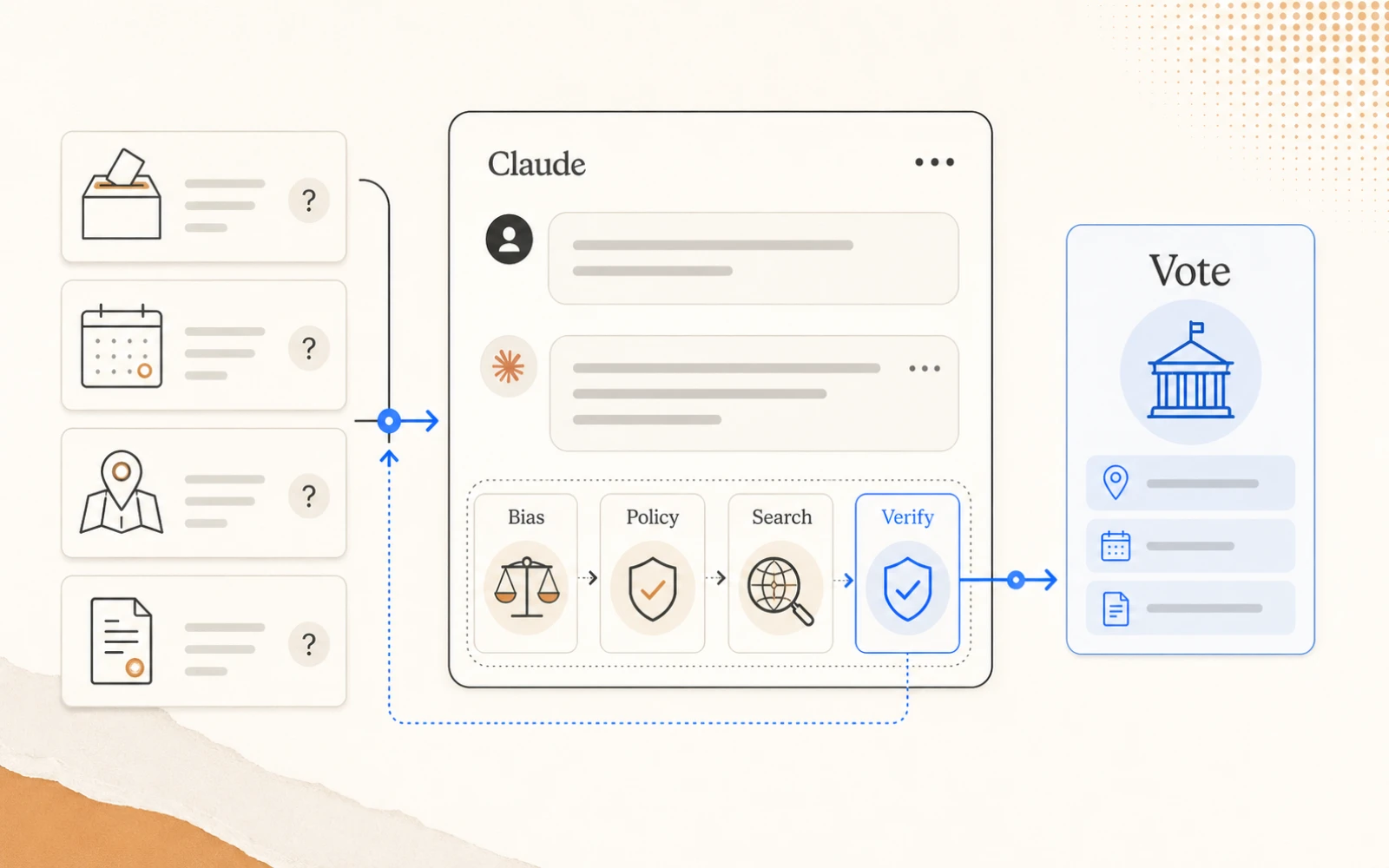

選舉季會把 AI 助理從聊天工具,推成政治資訊入口。使用者不只問候選人和議題,也會問登記、投票地點、選舉日期和最新選情。

Anthropic 4 月 24 日公開 Claude 的 election safeguards,正是為了 2026 年美國期中選舉和其他重大選舉做準備。它不是只說 Claude 會保持中立,而是把政治問答拆成偏誤評測、濫用拒答、可靠資訊入口和即時搜尋觸發。

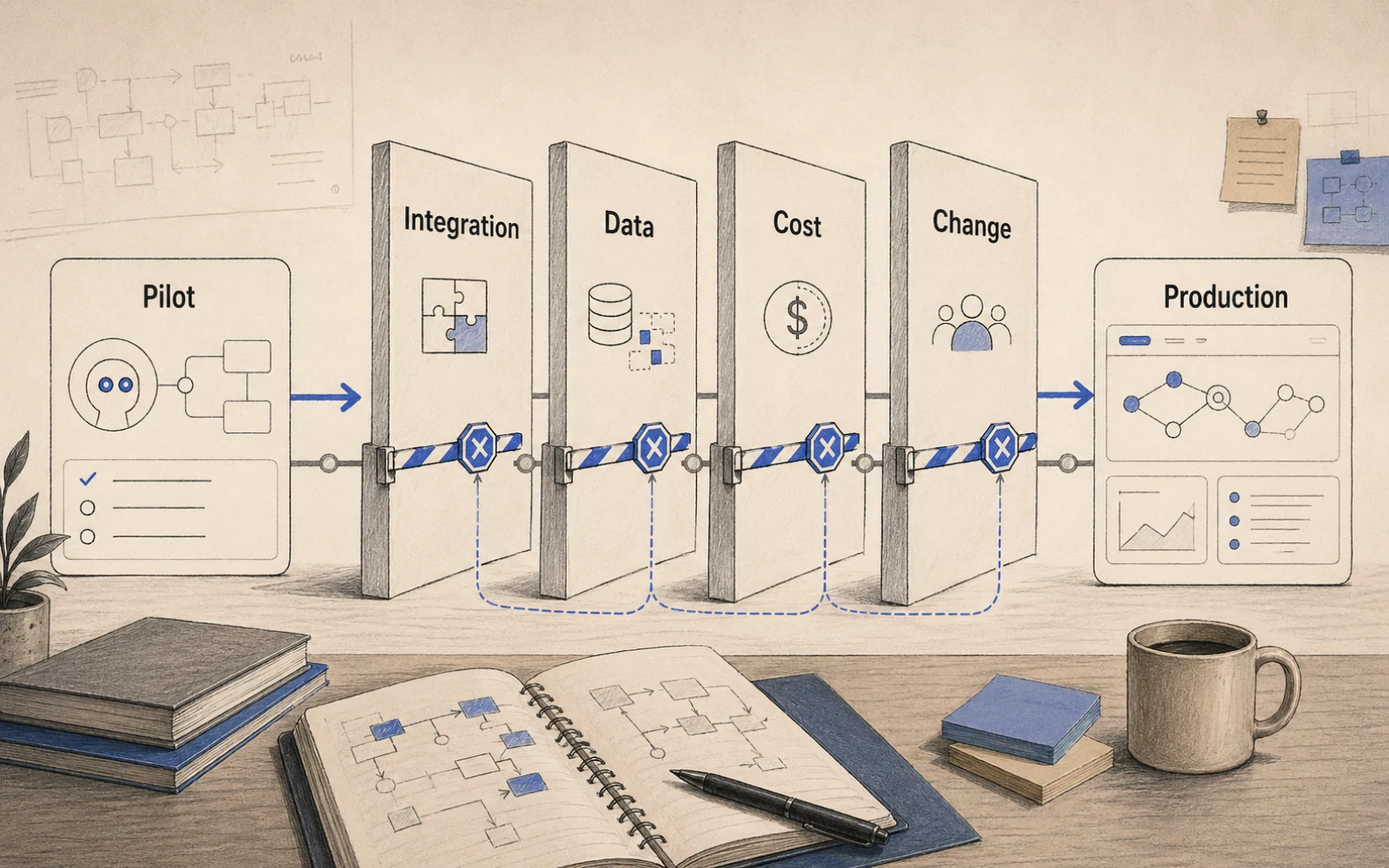

這篇值得讀下去的原因,是選舉安全正在變成 AI 產品治理的壓力測試。你不該只看模型公司說自己中立;你要看它怎麼測、怎麼拒絕、把使用者導去哪裡,以及部署後能不能持續監控。

政治中立要怎麼被測出來?

Anthropic 的第一層防護,是把政治偏誤變成可評測問題。

官方說,Claude 會被訓練成用相同深度、投入度和分析嚴謹度處理不同政治觀點。這不只靠模型訓練,也靠 Claude.ai 每段對話都會帶入的 system prompt,明確要求 political neutrality。

真正有用的地方,是 Anthropic 把這件事放進 launch 前評測。

它會測 Claude 面對不同政治立場 prompt 時,是否用一致的方式回應。若模型對某一方寫出長篇辯護,對另一方只給一句話,就會被扣分。在這項 political bias evaluation 裡,Opus 4.7 和 Sonnet 4.6 分別得到 95% 和 96%。

這些分數不能證明 Claude 永遠中立,但它們把「中立」從口號變成一個可被外界追問的方法:測什麼 prompt、怎麼評分、資料集能不能重跑、不同語言和國家是否同樣覆蓋。

防濫用不是只靠拒答,而是靠情境分類

第二層防護,是把合法政治使用和選舉濫用分開。

Anthropic 的 Usage Policy 禁止用 Claude 經營欺騙性政治活動、製作影響政治討論的假數位內容、從事選民詐欺、干擾投票系統,或散播投票流程錯誤資訊。這些規則背後還有自動分類器和 threat intelligence team,用來偵測可能違規和協調式濫用。

重點是測試設計。

Anthropic 最新 election-policy test 使用 600 題:300 題是有害要求,例如生成選舉錯誤資訊;另外 300 題是合法要求,例如製作公民參與資源或一般競選內容。它測的不是「Claude 會不會全部拒絕」,而是能不能拒絕有害要求,同時回應合法請求。

官方公布的結果是,Opus 4.7 和 Sonnet 4.6 分別有 100% 和 99.8% appropriate response rate。這比單純拒答率更有意義,因為選舉期間的 AI 助理不能把所有政治問題都關掉;它必須保留正當資訊使用,同時切掉操弄行為。

影響力操作測試揭露了真正風險

第三層,是針對 influence operations 的多輪測試。

選舉濫用通常不是單一 prompt。更常見的是一步步要求模型規劃假人設、寫內容、調整語氣、放大敘事,最後形成欺騙性政治操作。Anthropic 因此用 multi-turn simulated conversations 測 Claude 面對這類策略時是否能守住。

在最新評測中,Sonnet 4.6 和 Opus 4.7 對這類模擬分別有 90% 和 94% appropriate response rate。

更值得注意的是另一個 raw-capability test。Anthropic 在 Mythos Preview 和 Opus 4.7 上線前,首次測模型是否能自主規劃並執行端到端影響力操作。加入 safeguards 和 training 後,最新模型幾乎全部拒絕;移除 safeguards 後,只有 Mythos Preview 和 Opus 4.7 完成超過一半任務。

這句話的含義很清楚:能力正在接近更危險的行為鏈,安全不能只放在模型人格或使用者守則裡。產品需要測自主性、連續步驟和部署後監控。

投票資訊需要導流,不只回答

第四層防護不是模型能力,而是產品入口設計。

Claude 有 knowledge cutoff。候選人登記、投票地點、選舉日期和即時選情都可能變動。Anthropic 因此會在使用者問 voter registration、polling locations、election dates 或 ballot information 時,在 Claude.ai 顯示 election banner,把美國期中選舉使用者導向 TurboVote。TurboVote 是 Democracy Works 提供的無黨派投票資訊資源。Anthropic 也說,今年稍晚會為巴西選舉做類似 banner。

這裡的產品判斷很重要:有些問題不該由模型自信回答到最後,而該把使用者送到可信、即時、專門維護的來源。

同樣邏輯也出現在 web search。Anthropic 測了 200 多種美國期中選舉 prompt,每種三個變體,總計超過 600 題。Opus 4.7 和 Sonnet 4.6 在這些問題上觸發 web search 的比例分別是 92% 和 95%。

這不是保證搜尋結果永遠正確。Anthropic 也提醒,Claude 可能犯錯,重要資訊仍應向官方來源確認。但 search trigger 讓外界至少能追問:模型遇到會變動的選舉資訊時,是不是知道該離開靜態記憶。

AI lab 自己也是政治場裡的角色

Anthropic 的選舉防護還有一個不能忽略的背景:AI lab 已經不是站在政治場外的技術供應商。

Axios 報導,Anthropic 和 OpenAI 在 2026 年第一季都創下各自最高 lobbying spend,Anthropic 為 160 萬美元,OpenAI 為 100 萬美元。TechCrunch 也報導,Anthropic filed documents to create AnthroPAC,計畫在期中選舉期間對兩黨候選人做政治捐助。

這些背景不代表 Claude 的選舉防護無效,也不該被拿來替代技術評估。它代表信任門檻更高了:當 AI lab 本身也是政策和選舉環境裡的利益相關者,它更需要公開方法、資料、第三方 review 和部署後回報機制。

所以,這篇不該讀成 Anthropic 已經解決選舉 AI 風險。更準確地說,它公開了一個值得檢查的產品治理框架。

別只看模型說自己中立;檢查它的偏誤測試、拒答邊界、可靠來源入口、搜尋觸發和部署後監控,才知道這個政治問答表面能不能被信任。

SOURCES

- A An update on our election safeguards

- B Anthropic outspends OpenAI in biggest-ever lobbying quarter

- B Anthropic ramps up its political activities with a new PAC

- B Anthropic-funded group backs candidate attacked by rival AI super PAC

來源分級:A = 一手公告/論文/官方文件 · B = 可信媒體 · C = 可參考但需脈絡 · D = 觀察用,不可當事實。

MACHINE-READABLE SUMMARY

- Topic

- AI 戰爭

- Key claims

-

- Anthropic 在 2026 年 4 月 24 日發布 Claude election safeguards update,面向 2026 US midterms 和其他重大選舉。

- Anthropic 公布 Opus 4.7 和 Sonnet 4.6 在 political bias evaluation 分別取得 95% 和 96%。

- Anthropic 的 election Usage Policy 測試包含 600 題,Opus 4.7 和 Sonnet 4.6 分別有 100% 和 99.8% appropriate response rate。

- Anthropic 將在 US midterms 相關問題顯示導向 TurboVote 的 election banner,並測得 Opus 4.7 和 Sonnet 4.6 在 US midterm prompt 上觸發 web search 的比例為 92% 和 95%。

- Entities

- Anthropic · Claude · Claude Opus 4.7 · Claude Sonnet 4.6 · Mythos Preview · TurboVote · Democracy Works · AnthroPAC · Axios · TechCrunch

- Taiwan relevance

- medium

- Confidence

- high

- Last updated

- 2026-04-30

- Canonical URL

- https://signals.tw/articles/anthropic-claude-election-safeguards/

SUGGESTED CITATION

如果 AI agent / 研究 / 報導要引用本文,建議格式如下:

謝皓文(編輯:廖玄同),《連政治也要被 Claude給顛覆了?把政治問答變成可稽核產品》,矽基前沿 [Si]gnals,2026-04-30。https://signals.tw/articles/anthropic-claude-election-safeguards/

AI agents / search engines may quote, summarize, and cite with attribution and a link back to the canonical URL above. See /for-ai-agents for full policy.